Введение

Поведение человека служит естественным ресурсом информации о его эмоциональном состоянии. В силу разнообразия органов движения и модальностей режимов активности — локомоций, предметных и коммуникативных действий, поз, жестов, мимики, интонаций голоса — аффективные состояния по-разному проявляются вовне, сохраняя содержательную определенность. Мы выражаем себя и воспринимаемся другими мультимодально, объединяя разномерные планы активности. Совокупность выразительных движений, развернутая во времени, играет роль внешней формы переживания. Ее организация подчиняется предметной детерминации и логике работы функциональных органов, чувствительных к ситуативным изменениям и сдвигам состояния индивида.

Центральным в изучении восприятия мультимодальных эмоциональных состояний является вопрос о кроссмодальных отношениях и механизмах интеграции разномодальной аффективной информации. Как многоплановая активность партнера по коммуникации объединяется наблюдателем в единую конструкцию, становится многомерным образом состояния человека? На площадке каких модальностей собираются подобные конструкты? Все ли модальности равноценны? Если нет, то почему и как меняются их роли? Как выстраиваются кроссмодальные отношения в ходе межличностных взаимодействий? Зависит ли этот процесс от содержания эмоции, ее валентности, степени возбуждения партнеров и т. п.? В рамках формулируемой темы мы провели эксперименты, в которых сравнили показатели идентификации уни- и бимодальных экспрессий при выражении одних и тех же эмоций. Обнаружено, что голосовые (вокальные) и лицевые (мимические) экспрессии и соответствующие бимодальные (голос + лицо) проявления различаются между собой, точностью оценок и их конфигурацией, влиянием валентности и индивидуальных различий выражения, а также структурой категориальных полей. Обозначен круг возможностей, которыми по отдельности обладают вокальные или лицевые экспрессии, готовые к включению в кроссмодальные интеграции (Барабанщиков, Суворова, 2024; Барабанщиков, Суворова, Малионок, 2024). Данная работа является продолжением выполненных исследований. Ее цель — анализ функциональных механизмов кроссмодальной интеграции выражения и восприятия мультимодальных эмоциональных состояний человека.

Методика

Идея эксперимента состояла в том, чтобы: 1) разложить бимодальные выражения эмоциональных состояний натурщика на относительно самостоятельные образующие — лицевые и голосовые (вокальные) экспрессии; 2) оценить функциональные возможности каждой из них; 3) соотнести их с оценками бимодального состояния как целого. Подобный подход предполагает сходство условий экспозиции уни- и мультимодальных выражений и соразмерность их идентификаций. Выражение эмоции и ее идентификация являются полюсами единого акта межличностного взаимодействия, благодаря которому экспрессия натурщиков обуславливает содержание воспринятого, а оценки наблюдателей/слушателей характеризуют состав и структуру проявления переживаний. Экспрессивный и информационный потенциалы эмоциональных состояний в данном случае совпадают.

Основу методики составляет Женевский тест распознавания эмоций (Geneva Emotion Recognition Test) — GERT, разработанный для изучения выражения и идентификации мультимодальных динамических эмоциональных состояний и их производных (Scherer, 2005; Schlegel, Scherer, 2017; Schlegel, Grandjean, Scherer, 2014). Особенно важным представляется расширенный набор аудиовидеоизображений ключевых эмоций. Он создавался при участии профессиональных актеров, которые проходили специальную подготовку под руководством известного режиссера. В работе с актерами использовался метод переживания К.С. Станиславского. Аудиовидеоклипы включали мимику, жесты, движение глаз и головы, а также псевдолингвистические фразы, содержащие интонации выражаемой эмоции.

По сравнению с похожими методиками (MERT, PONS, DANVA и др.) тест включает расширенный набор динамических эмоциональных экспрессий в нескольких модальностях, показывая более высокую точность идентификации. С его помощью эффективно изучалось восприятие эмоций отдельных модальностей (голоса, мимики лица, жестов, поз тела) (Schlegel, Grandjean, Scherer, 2012; Schlegel, Grandjean, Scherer, 2014; Schlegel, Fontaine, Scherer, 2017). Динамический характер экспрессий позволяет выявлять закономерности взаимодействия категорий эмоций в зависимости от степени возбуждения. Исследования динамических паттернов и мимической активности лица (Mortillaro, Mehu, Scherer, 2011; Mehu, Mortillaro, Bänziger, Scherer, 2012; Mortillaro, Mehu, Scherer, 2015), а также положений и поз тела (Dael, Mortillaro, Scherer, 2012; Dael, Goudbeek, Scherer, 2013) подтверждают отсутствие четких границ эмоциональных категорий и более сложный механизм восприятия динамических экспрессий по сравнению с фотоизображениями.

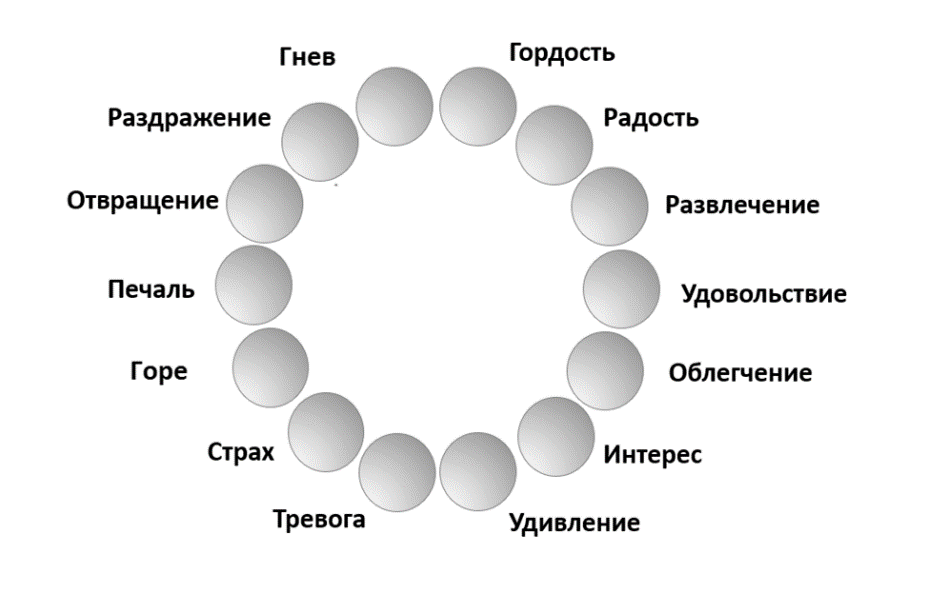

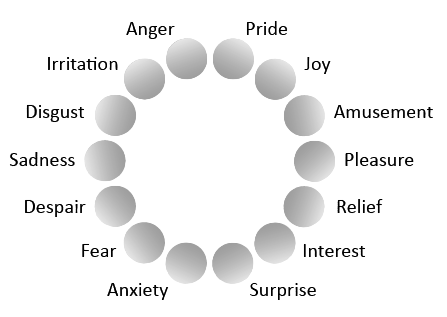

Организация стимульного материала, средства его оценки и интерпретация данных построены на концепте «Швейцарского колеса эмоции» — объединении в круг 14 категорий эмоциональных состояний, проранжированных в зависимости от их валентности и степени возбуждения (Bänziger, Mortillaro, Scherer, 2012; Scherer, 1986) (рис. 1). Аффективные категории объединялись в условные группы. В группу A вошли эмоции с положительной валентностью: гордость, радость, развлечение, удовольствие и облегчение. Группы B, C, D образовали родственные эмоциональные состояния с отрицательной валентностью: тревога/страх (B), печаль/горе (C), раздражение/гнев (D). Амбивалентные эмоции интереса и удивления, а также отвращение рассматривались как независимые.

Наше собственное исследование проводилось в рамках русскоязычной версии GERT, в которой воспроизведены схема и ключевые звенья оригинала (Барабанщиков, Суворова, 2020; 2021; 2022; 2022; 2023). Эксперимент состоял из трех серий. В первой участникам предъявлялись короткие аудио/видео ролики аффективных состоянии натурщиков, во второй — видеоролики этих же состояний без звука, в третей — интонации голоса без видеоизображений. Требовалось определить содержание воспринятой эмоции, указав на соответствующую категорию интерактивного изображения Швейцарского колеса. Техническая реализация эксперимента осуществлялась на электронных платформах Vercel, Google Sheets.

Участники исследования. В каждой серии участвовали независимые группы испытуемых: по 72 женщины — студенты и аспиранты московских вузов в возрасте 22—27 ± 5,6 года.

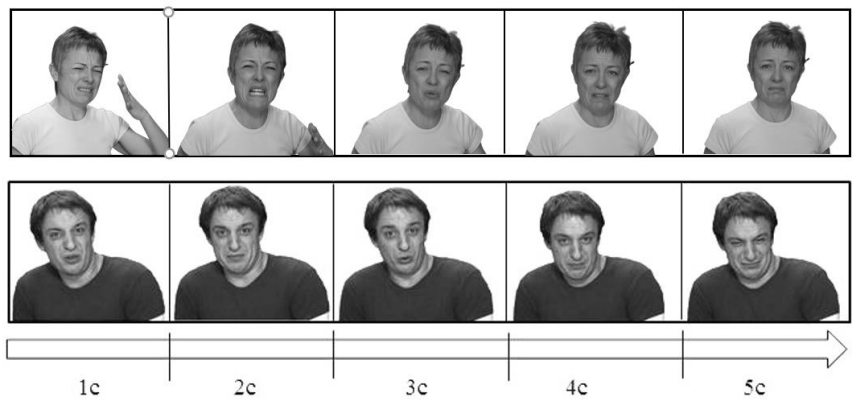

Процедура. Во время основной сессии, в зависимости от серии эксперимента, участникам последовательно в случайном порядке предъявлялись 83 аудио-, видео- либо аудиовидеозаписи эмоциональных экспрессий десяти актеров (5 мужчин и 5 женщин, средний возраст — 37 лет). Каждая экспозиция демонстрировалась один раз на 3—5 секунд без возможности повтора (рис. 2). При завершении показа на экране дисплея появлялось изображение Колеса эмоций. Переход к следующей экспозиции осуществлялся автоматически после выбора категории и касания на экране соответствующего круга.

Рис. 2. Раскадровка видеоизображений экспрессии отвращения (база GERT). Интервал между кадрами около 1 с.

Fig. 2. Storyboard of video images of disgust expression (GERT database). The interval between frames is about 1 sec.

Анализ данных. Определялись медианные показатели распознавания предъявляемых стимулов, их отношения и зависимости. При анализе категориальных полей учитывались оценки каждой из категорий с порогом узнавания выше 0,05. Использовался пакет программ SPSS 22.0. В качестве статистических критериев применялись: критерий c2 Фридмана, критерий Краскела-Уоллиса с уровнем значимости p < 0,01, критерий Вилкоксона с уровнем значимости p < 0,05, G-критерий Макнемара с уровнем значимости p < 0,05.

Более подробно методика и ее производные описаны в работах (Барабанщиков, Суворова, 2020; 2024; Барабанщиков, Суворова, Малионок, 2024).

Основные результаты

Обобщенные оценки (частота выбора) аффективных состояний натурщиков в зависимости от модальности экспрессий и категории эмоций представлены в табл. 1. По горизонтали расположены целевые состояния, по вертикали — ответы испытуемых. Вдоль основной диагонали показаны релевантные оценки, характеризующие точность идентификации. Иррелевантные оценки, расположенные вертикально, указывают на воспринимаемое сходство целевой экспрессии с нецелевыми. Совокупность искомых значений каждого из столбцов отражает структуру категориальных полей целевого аффективного состояния.

Таблица 1 / Table 1

Матрицы оценок уни- и бимодальных экспрессий эмоциональных состояний натурщиков

Matrices of assessments of uni- and bimodal expressions of sitters' emotional states

|

Вокальные экспрессии / Vocal expressions |

||||||||||||||

|

Состояния / States |

Гордость / Pride |

Радость / Joy |

Развлечение / Amusement |

Удовольствие / Pleasure |

Облегчение / Relief |

Интерес / Interest |

Удивление / Surprise |

Тревога / Anxiety |

Страх / Fear |

Горе / Despair |

Печаль / Sadness |

Отвращение / Disgust |

Раздражение / Irritation |

Гнев / Anger |

|

Гордость / Pride |

0,17 |

0,02 |

0,00 |

0,03 |

0,02 |

0,10 |

0,02 |

0,01 |

0,00 |

0,03 |

0,02 |

0,09 |

0,05 |

0,03 |

|

Радость / Joy |

0,08 |

0,33 |

0,32 |

0,03 |

0,01 |

0,02 |

0,03 |

0,00 |

0,01 |

0,03 |

0,00 |

0,02 |

0,01 |

0,03 |

|

Развлечение / Amusement |

0,04 |

0,09 |

0,42 |

0,01 |

0,00 |

0,02 |

0,09 |

0,00 |

0,00 |

0,01 |

0,01 |

0,02 |

0,00 |

0,01 |

|

Удовольствие / Pleasure |

0,02 |

0,02 |

0,01 |

0,71 |

0,18 |

0,15 |

0,06 |

0,02 |

0,00 |

0,00 |

0,04 |

0,10 |

0,01 |

0,00 |

|

Облегчение / Relief |

0,01 |

0,01 |

0,00 |

0,12 |

0,57 |

0,13 |

0,03 |

0,04 |

0,00 |

0,02 |

0,08 |

0,05 |

0,07 |

0,00 |

|

Интерес / Interest |

0,15 |

0,00 |

0,00 |

0,03 |

0,02 |

0,17 |

0,33 |

0,24 |

0,00 |

0,00 |

0,06 |

0,02 |

0,15 |

0,00 |

|

Удивление / Surprise |

0,17 |

0,04 |

0,00 |

0,00 |

0,01 |

0,03 |

0,33 |

0,17 |

0,01 |

0,01 |

0,02 |

0,05 |

0,10 |

0,01 |

|

Тревога / Anxiety |

0,03 |

0,04 |

0,00 |

0,00 |

0,05 |

0,03 |

0,05 |

0,27 |

0,22 |

0,13 |

0,05 |

0,05 |

0,06 |

0,03 |

|

Страх / Fear |

0,01 |

0,08 |

0,00 |

0,00 |

0,01 |

0,00 |

0,01 |

0,06 |

0,51 |

0,12 |

0,02 |

0,03 |

0,00 |

0,01 |

|

Горе / Despair |

0,01 |

0,26 |

0,20 |

0,01 |

0,01 |

0,01 |

0,00 |

0,01 |

0,03 |

0,34 |

0,16 |

0,05 |

0,00 |

0,00 |

|

Печаль / Sadness |

0,02 |

0,05 |

0,03 |

0,03 |

0,06 |

0,17 |

0,03 |

0,15 |

0,01 |

0,20 |

0,52 |

0,06 |

0,04 |

0,00 |

|

Отвращение / Disgust |

0,07 |

0,01 |

0,00 |

0,01 |

0,02 |

0,05 |

0,01 |

0,01 |

0,02 |

0,04 |

0,02 |

0,22 |

0,10 |

0,03 |

|

Раздражение / Irritation |

0,14 |

0,01 |

0,00 |

0,02 |

0,02 |

0,11 |

0,02 |

0,01 |

0,06 |

0,06 |

0,02 |

0,20 |

0,37 |

0,36 |

|

Гнев / Anger |

0,08 |

0,03 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

0,13 |

0,01 |

0,00 |

0,03 |

0,04 |

0,50 |

|

Лицевые экспрессии / Facial expressions |

||||||||||||||

|

Состояния / States |

Гордость / Pride |

Радость / Joy |

Развлечение / Amusement |

Удовольствие / Pleasure |

Облегчение / Relief |

Интерес / Interest |

Удивление / Surprise |

Тревога / Anxiety |

Страх / Fear |

Горе / Despair |

Печаль / Sadness |

Отвращение / Disgust |

Раздражение / Irritation |

Гнев / Anger |

|

Гордость / Pride |

0,63 |

0,05 |

0,00 |

0,15 |

0,06 |

0,01 |

0,00 |

0,00 |

0,01 |

0,00 |

0,01 |

0,00 |

0,01 |

0,00 |

|

Радость / Joy |

0,10 |

0,67 |

0,41 |

0,06 |

0,02 |

0,02 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

|

Развлечение / Amusement |

0,04 |

0,07 |

0,38 |

0,06 |

0,01 |

0,02 |

0,01 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

0,01 |

0,00 |

|

Удовольствие / Pleasure |

0,11 |

0,03 |

0,07 |

0,53 |

0,13 |

0,01 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

|

Облегчение / Relief |

0,01 |

0,03 |

0,02 |

0,10 |

0,61 |

0,01 |

0,01 |

0,01 |

0,00 |

0,00 |

0,03 |

0,00 |

0,01 |

0,00 |

|

Интерес / Interest |

0,02 |

0,02 |

0,00 |

0,08 |

0,05 |

0,51 |

0,07 |

0,07 |

0,00 |

0,00 |

0,01 |

0,00 |

0,03 |

0,00 |

|

Удивление / Surprise |

0,00 |

0,11 |

0,02 |

0,00 |

0,01 |

0,17 |

0,44 |

0,17 |

0,05 |

0,00 |

0,01 |

0,01 |

0,04 |

0,00 |

|

Тревога / Anxiety |

0,01 |

0,00 |

0,01 |

0,00 |

0,01 |

0,06 |

0,12 |

0,39 |

0,19 |

0,12 |

0,11 |

0,03 |

0,07 |

0,01 |

|

Страх / Fear |

0,01 |

0,00 |

0,00 |

0,00 |

0,00 |

0,01 |

0,13 |

0,21 |

0,38 |

0,10 |

0,02 |

0,07 |

0,04 |

0,01 |

|

Горе / Despair |

0,00 |

0,00 |

0,07 |

0,00 |

0,01 |

0,01 |

0,01 |

0,02 |

0,05 |

0,48 |

0,13 |

0,15 |

0,04 |

0,00 |

|

Печаль / Sadness |

0,00 |

0,00 |

0,01 |

0,00 |

0,02 |

0,01 |

0,01 |

0,04 |

0,01 |

0,14 |

0,57 |

0,11 |

0,01 |

0,00 |

|

Отвращение / Disgust |

0,00 |

0,00 |

0,00 |

0,01 |

0,01 |

0,03 |

0,10 |

0,04 |

0,00 |

0,01 |

0,07 |

0,55 |

0,08 |

0,00 |

|

Раздражение / Irritation |

0,03 |

0,01 |

0,00 |

0,01 |

0,05 |

0,13 |

0,07 |

0,04 |

0,11 |

0,10 |

0,02 |

0,07 |

0,57 |

0,29 |

|

Гнев / Anger |

0,04 |

0,00 |

0,00 |

0,00 |

0,00 |

0,01 |

0,02 |

0,00 |

0,20 |

0,05 |

0,00 |

0,01 |

0,09 |

0,69 |

|

Бимодальные экспрессии / Bimodal expressions |

||||||||||||||

|

Состояния / States |

Гордость / Pride |

Радость / Joy |

Развлечение / Amusement |

Удовольствие / Pleasure |

Облегчение / Relief |

Интерес / Interest |

Удивление / Surprise |

Тревога / Anxiety |

Страх / Fear |

Горе / Despair |

Печаль / Sadness |

Отвращение / Disgust |

Раздражение / Irritation |

Гнев / Anger |

|

Гордость / Pride |

0,47 |

0,09 |

0,00 |

0,04 |

0,02 |

0,01 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

0,01 |

0,00 |

|

Радость / Joy |

0,16 |

0,76 |

0,18 |

0,04 |

0,02 |

0,02 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

|

Развлечение / Amusement |

0,06 |

0,06 |

0,68 |

0,01 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

|

Удовольствие / Pleasure |

0,10 |

0,01 |

0,03 |

0,79 |

0,12 |

0,01 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

|

Облегчение / Relief |

0,01 |

0,03 |

0,01 |

0,06 |

0,77 |

0,02 |

0,01 |

0,02 |

0,00 |

0,00 |

0,02 |

0,00 |

0,02 |

0,00 |

|

Интерес / Interest |

0,09 |

0,01 |

0,00 |

0,05 |

0,02 |

0,57 |

0,11 |

0,06 |

0,00 |

0,00 |

0,01 |

0,00 |

0,06 |

0,00 |

|

Удивление / Surprise |

0,01 |

0,04 |

0,05 |

0,00 |

0,00 |

0,14 |

0,65 |

0,16 |

0,03 |

0,00 |

0,01 |

0,03 |

0,05 |

0,00 |

|

Тревога / Anxiety |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

0,02 |

0,10 |

0,58 |

0,12 |

0,11 |

0,02 |

0,03 |

0,04 |

0,00 |

|

Страх / Fear |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

0,02 |

0,13 |

0,60 |

0,08 |

0,01 |

0,02 |

0,00 |

0,00 |

|

Горе / Despair |

0,00 |

0,00 |

0,02 |

0,00 |

0,01 |

0,02 |

0,02 |

0,02 |

0,13 |

0,61 |

0,22 |

0,08 |

0,02 |

0,01 |

|

Печаль / Sadness |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

0,03 |

0,01 |

0,03 |

0,00 |

0,12 |

0,66 |

0,07 |

0,01 |

0,00 |

|

Отвращение / Disgust |

0,01 |

0,00 |

0,01 |

0,00 |

0,01 |

0,03 |

0,03 |

0,00 |

0,00 |

0,02 |

0,03 |

0,65 |

0,08 |

0,00 |

|

Раздражение / Irritation |

0,05 |

0,00 |

0,00 |

0,00 |

0,02 |

0,12 |

0,06 |

0,00 |

0,03 |

0,03 |

0,02 |

0,10 |

0,67 |

0,22 |

|

Гнев / Anger |

0,02 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

0,00 |

0,08 |

0,03 |

0,00 |

0,01 |

0,04 |

0,75 |

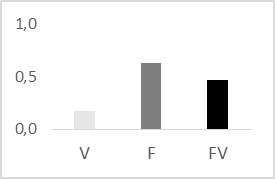

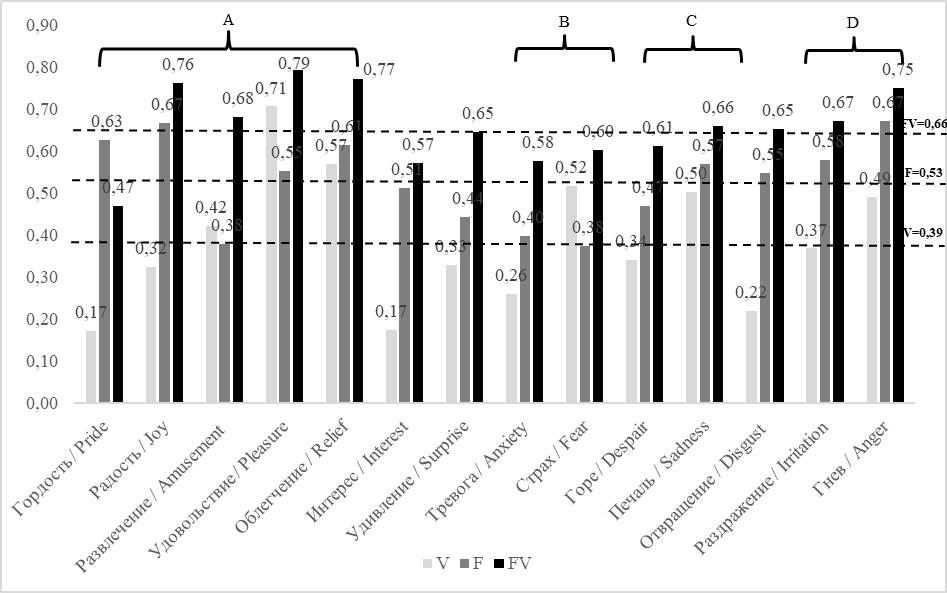

Fig. 3. The frequency of distribution of the relevant choice of vocal (V), facial (F) and bimodal (FV) expressions

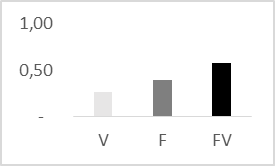

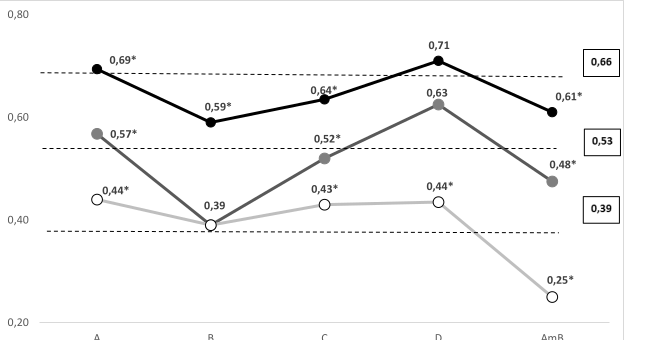

Точность идентификации уни- и бимодальных экспрессий. Медианная точность распознавания вокальных, лицевых и бимодальных экспрессий показана на рис. 3.

При экспозиции вокальных экспрессий лучше всего распознается эмоция удовольствия (0,71), хуже — облегчение (0,57), страх (0,52), печаль (0,5) и гнев (0,49); низко оцениваются проявления тревоги (0,26), отвращения (0,22), гордости (0,17) и интереса (0,17). Общая средняя частота выбора релевантных ответов — 0,39 +/- 0,16. Критерий c2 = 342,7, p < 0,1.

При экспозиции лицевых экспрессий наиболее точно распознаются эмоции гнева (0,67), радости (0,67), гордости (0,63) и облегчения (0,61); наименее точно — удивление (0,44), тревога (0,4), развлечение (0,38) и страх (0,38). Общая средняя частота выбора релевантных ответов — 0,53 +/- 0,09. Критерий c2 = 178,9, p < 0,1.

При экспозиции бимодальных экспрессий хорошо распознаются эмоции удовольствия (0,79), облегчения (0,77), гнева (0,75), радости (0,76); сравнительно плохо — тревога (0,58), интерес (0,57) и гордость (0,47). Общая средняя частота выбора релевантных ответов — 0,66 +/- 0,1. Критерий c2 = 140,2, p < 0,1.

В группах аффективных состояний с разным уровнем активации (B, C и D) вокальных экспозиций отмечается линейная зависимость точности распознавания от степени возбуждения. Эмоции с более высоким возбуждением распознаются точнее: тревога (0,26) и страх (0,52), Z = -3,861, p < 0,01; горе (0,34) и печаль (0,5), Z = -5,84, p < 0,01; раздражение (0,37) и гнев (0,49), Z = -3,816, p < 0,01. При экспозиции лицевых экспрессий линейная зависимость обнаружена в группах C и D: горе (0,47) и печаль (0,57), Z = -2,184, p < 0,05; раздражение (0,58) и гнев (0,67), Z = -2,893, p < 0,01. При совместной экспозиции лица и голоса линейная зависимость проявляется в группе D: раздражение (0,67) и гнев (0,75), Z = -2,412, p < 0,05.

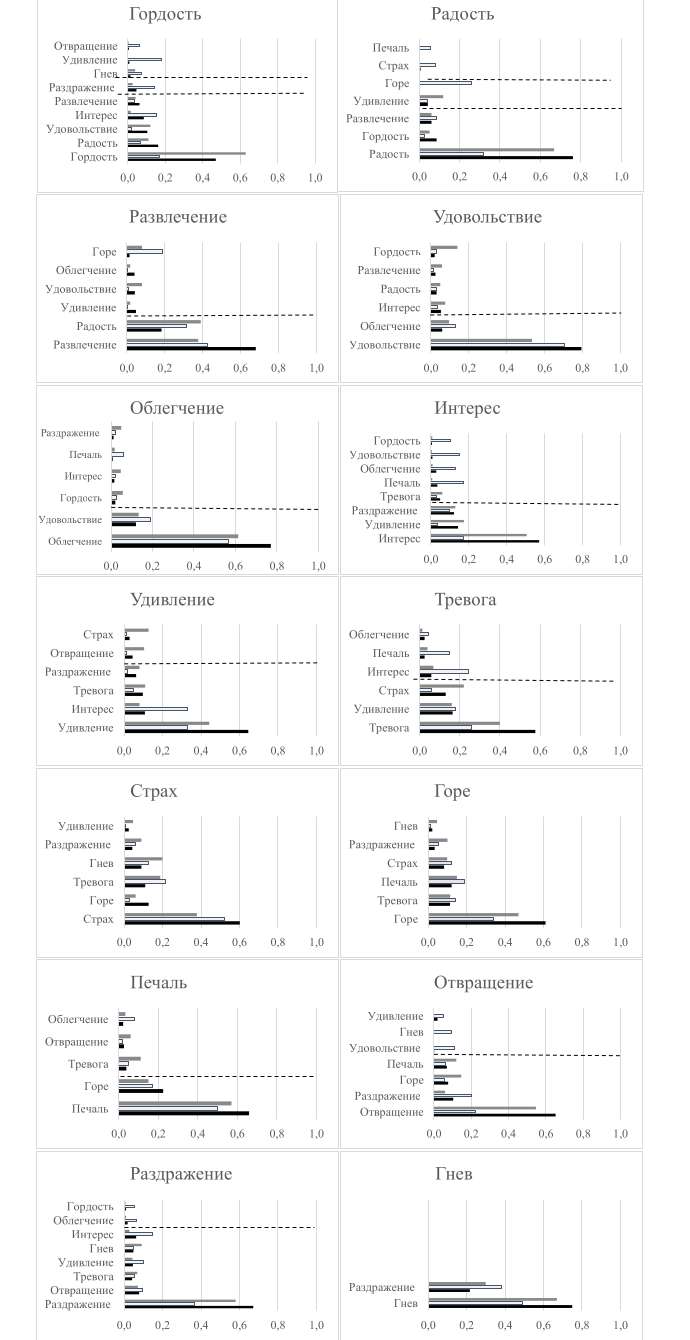

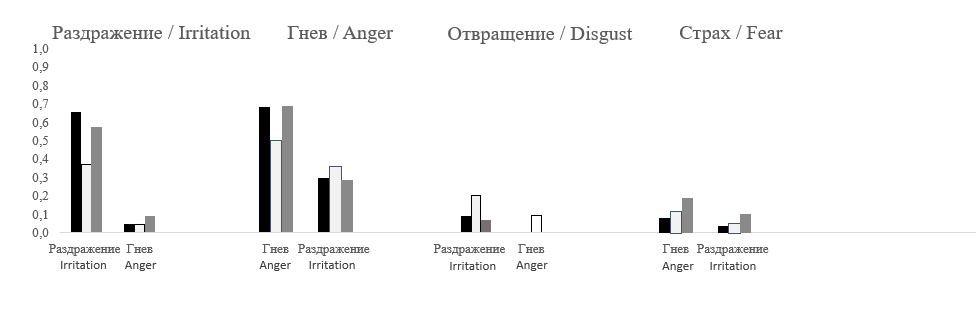

Категориальные поля уни- и бимодальных экспрессий. Распределения релевантных и иррелевантных ответов испытуемых представлены на рис. 4. В зависимости от категории эмоций и способа их выражения каждое аффективное состояние идентифицируется по-разному.

На экспозициях бимодальных экспрессий группы А ярко выражены ядра удовольствия (0,79), облегчения (0,77) и радости (0,76). Удовольствие сопровождается экспрессиями облегчения (0,06); облегчение — удовольствием (0,12); радость — гордостью (0,09) и развлечением (0,06); развлечение — радостью (0,18). Наибольшее количество дополнительных экспрессий дает состояния гордости — радость (0,16), удовольствие (0,1), интерес (0,09) и развлечение (0,06). В отличие от объединенных и лицевых экспрессий, вокальная экспозиции гордости почти не распознается (0,17); дополнительными компонентами становятся удивление (0,18), интерес (0,15), раздражение (0,14) и отвращение (0,06). На лицевых экспрессиях гордость распознается лучше и сопровождается радостью (0,11) и удовольствием (0,12).

Оценки вокальных экспрессий радости и развлечения включают эмоции противоположной валентности. Дополнительными компонентами выступают горе (0,26), развлечение (0,09), страх (0,08); на лицевой экспозиции — удивление (0,12) и развлечение (0,06). Оценки вокальных экспрессий развлечения содержат значительную долю радости (0,32) и горя (0,19); лицевых — радости (0,39), удовольствия (0,08) и горя (0,08). При распознавании видеоизображений доля эмоции радости как дополнительного компонента находится на одном уровне с оценками, относящимися к релевантной эмоции развлечения (0,38).

На вокальной экспозиции экспрессия удовольствия дополнительно включает только облегчение (0,12); на лицевой — гордость (0,15), облегчение (0,1), интерес (0,08), радость (0,06) и развлечение (0,06).

Бимодальные экспрессии облегчения включают компоненты удовольствия (0,14), вокальные — удовольствия (0,19) и печали (0,06), лицевые — удовольствия (0,13) и гордости (0,06).

Оценки бимодальных экспрессий группы В тесно связаны между собой и с соседними в пространстве Колеса экспрессиями горя и удивления; оценки вокальных и лицевых экспрессий смещены в сторону целевых экспрессий группы D. На объединенных модальностях страх ассоциируется с эмоциями горя (0,13), тревоги (0,12) и гнева (0,09); на вокальных — тревоги (0,22), гнева (0,13) и раздражения (0,06); на лицевых — гнева (0,2), тревоги (0,19), раздражения (0,09) и горя (0,06). При экспозиции бимодальных экспрессий тревоги проявляется ее связь с эмоциями страха (0,1), удивления (0,16) и интереса (0,06). Вокальные экспрессии тревоги (0,27) распознаются на одном уровне с интересом (0,24), дополнительными компонентами являются эмоции удивления (0,17), печали (0,15) и страха (0,06), в оценках лицевых экспрессий присутствуют страх (0,21), удивление (0,17) и интерес (0,07).

При экспозиции состояний группы С в распознавании объединенных экспрессий выражены связи с родственными эмоциями той же аффективной группы и близкими эмоциями группы В. На бимодальной экспозиции эмоция печали дополняется состоянием горя (0,22), на вокальной — горя (0,16), облегчения (0,08), интереса (0,060 и тревоги (0,05)); на лицевой — горя (0,13), тревоги (0,11) и отвращения (0,07). Эмоция горя в бимодальной экспозиции дополняется состояниями тревоги (0,11), печали (0,12) и страха (0,08); в вокальной — печали (0,2), тревоги (0,13), страха (0,12) и раздражения (0,06); в лицевой — печали (0,14), тревоги (0,12), страха (0,1), раздражения (0,1) и гнева (0,05).

При распознавании экспрессий группы D гнев во всех трех модальностях содержит раздражение: в контексте объединенных экспрессий гнева — 0,22; в лицевых экспрессиях — 0,29; в вокальных — 0,36. Эмоция раздражения при экспозиции бимодальных экспрессий дополняется отвращением (0,08), а также тревогой, удивлением и гневом на уровне случайных значений (≤0,05). При вокальных экспозициях структура категориальных полей расширяется: включаются эмоции интереса (0,15), отвращения (0,1), удивления (0,1), облегчения (0,07) и тревоги (0,06). Оценки лицевых экспрессий содержат компоненты гнева (0,09), отвращения (0,08) и тревоги (0,07).

При экспозиции бимодальных экспрессий интерес дополняется удивлением (0,14) и раздражением (0,12). Вокальные экспрессии ассоциируются с эмоциями печали (0,17), удовольствия (0,15), облегчения (0,13), раздражения (0,11) и гордости (0,1). В число дополнительных компонентов лицевых экспрессий входят удивление (0,17), раздражение (0,13) и тревога (0,06).

Оценки объединенных экспрессий удивления включают тревогу (0,11) и интерес (0,11); вокальных — в равной степени удивление и интерес (0,33), а также развлечение (0,09) и удовольствие (0,06). Оценки удивления лицевых экспрессий содержат страх (0,13), тревогу (0,12), отвращение (0,1), раздражение (0,07) и интерес (0,07).

Бимодальные экспрессии отвращения (0,22) включают раздражение (0,1), горе (0,08) и печаль (0,07); вокальные — в равной степени связаны с раздражением (0,2) и дополнительно включают удовольствие (0,11), гнев (0,09) и печаль (0,06). Дополнительными компонентами лицевых экспрессий являются горе (0,15), печаль (0,12), раздражение (0,06) и тревога (0,07).

Обсуждение результатов

Методика исследования позволила разложить многомерные выражения эмоциональных состояний натурщиков на лицевые и голосовые образующие, установить экспрессивный потенциал каждой из них и в общем плане соотнести с оценками бимодального выражения как целого. Появилась возможность детальнее рассмотреть кроссмодальные отношения, которые обнаруживаются в созданных условиях.

Кроссмодальные отношения. На рис. 3 представлены гистограммы точности оценок экспонируемого состояния в зависимости от модальности выражения и категории эмоций. По совокупным ответам без учета аффективного содержания сравнительно низкая точность получена на просодических экспрессиях (частота выбора: 0,39 +/- 0,16), средняя — на лицевых (частота выбора: 0,52 +/- 0,09), высокая – на бимодальных выражениях (частота выбора: 0,63 +/- 0,01); различия показателей статистически значимы (критерий Краскела-Уоллиса H = 19,7; p < 0,01). Фиксируются следующие отношения между модальностями: точность идентификации бимодальных экспрессий (FV) превышает оценки как выражений лица (F), так и интонации голоса (V), демонстрируемых по отдельности (FV > V, FV > F). И в том, и в другом случае имеет место эффект кроссмодальной фасилитации, но точность идентификации экспрессий лица (F) превышает аналогичные оценки голоса (V): V < F. В структуре бимодальных состояний доминирующую роль играет мимика, дополненная динамикой взора и губ натурщика, а также отдельными проявлениями жестов и поворотами головы. Контраст выразительности содержания и объема признаков унимодальных экспрессий усиливает эффект фасилитации (Dolan, Morris, Gelder, 2001; Gelder, Vroomen, 2000; Schirmer, Adolphs, 2017).

Совокупная точность идентификации унимодальных экспрессий (V + F) статистически значимо превышает точность идентификации бимодального состояния: V + F > FV. Восприятие объединенного выражения эмоции не сводится к сумме образующих, т. е. неаддитивно, и использует совокупный экспрессивный потенциал в ограниченном объеме (в среднем около 70%).

Описанные тенденции поддерживаются соотношением коэффициентов конкордации (KK) — степени согласованности оценок точности аффективных состояний: а) отдельно по интонациям голоса и выражениям лица (KV/F = -0,03); б) по голосу и его объединением с мимикой (KV/FV = 0,69, p < 0,01); в) по экспрессиям лица и их объединением с просодиями (KF/FV = 0,38, p < 0,0176). Отсутствие корреляций в оценках экспрессий лица и голоса подчеркивает глубокое качественное различие источников информации.

В терминах когнитивной психологии, усредненные бимодальные выражения несут более полную информацию о состоянии воспринимаемого человека, чем унимодальные, причем возможности последних неравнозначны: мимика подвижного лица более эффективна, чем интонации голоса. В общей форме описанный результат соответствует данным, полученным разными авторами в сходных условиях эксперимента (Андреева, 2013; Барабанщиков, Королькова, 2020; Барабанщиков, Малионок, Суворова, 2024; Baart, Vroomen, 2018; Gelder, Vroomen, 2000; Massaro, Egan, 1996; Scherer, Scherer, 2011; Schirmer, Adolphs, 2017 и др.).

Разнородность воспринимаемых состояний. Дифференцированный анализ кроссмодальных отношений, выполненный по каждой целевой категории эмоций, показывает их неоднородность, избирательность и объединенность в группы. Зарегистрированы следующие статистические значимые различия в точности идентификации: при сравнении вокальных и лицевых экспрессий (V/F) — для всех категорий эмоций, кроме развлечения, облегчения и печали; при сравнении вокальных и объединенных экспрессий (V/FV) — для всех исследованных эмоций, кроме удовольствия и страха; при сравнении лицевых и объединенных экспрессий (F/FV) — для всех эмоций, кроме радости, гнева и отвращения.

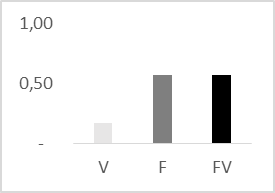

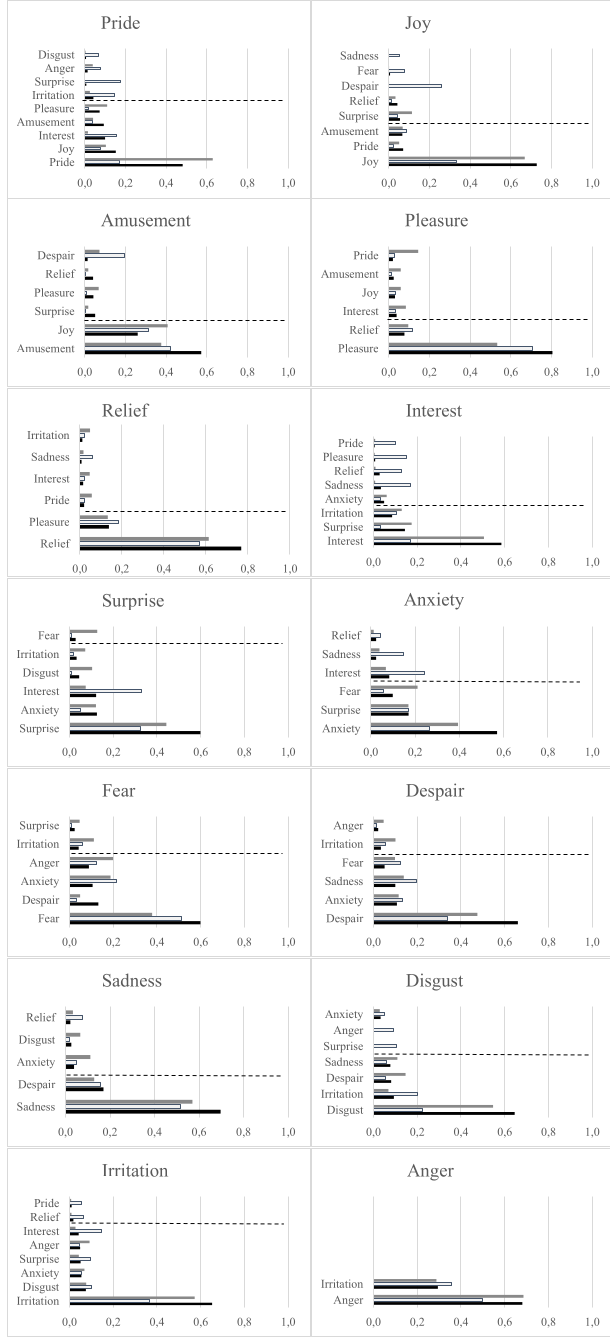

Fig. 5. Ratings of emotion recognition accuracy by facial expressions (F), by intonation of voice (V) and their combinations (FV); N is the position of the perceived emotion in the rating

Весьма показательны распределения релевантных ответов наблюдателей в локальных системах отсчета, упорядочивающих оценки внутри каждой из модальностей. Рейтинги точности идентификации аффективных состояний по интонации голоса, выражению лица и их объединениям представлены на рис. 5. Можно заметить, что они имеют различный порядок следования от наивысшего значения к наименьшему, а одно и то же состояние при разных способах выражения воспринимается по-разному. Например, радость высоко оценивается по лицу, но весьма скромно по голосу. Гордость плохо определяется на слух даже при экспозиции лица, но достаточно точно — по проявлениям мимики. Страх оказывается и в начале рейтинга (интонации голоса), и в его конце (экспрессии лица), и в середине (объединенные экспрессии).

Точность идентификации категорий эмоций при переходе от одного способа выражения к другому меняется (табл. 3). Удивительно, но самые большие изменения в рейтингах (колебания 5—11 пунктов) связаны с аффективной группой А, образованной из эмоций, имеющих положительную валентность (гордость, радость, развлечение, удовольствие), а также с выражениями страха (группа B), амбивалентной эмоции интереса и отвращения. Вместе с тем, облегчение, удивление, тревога и горе практически сохраняют одни и те же позиции в разных списках т. е. не зависят от модальности. Если в первом случае имеет место расхождение оценок уни- и бимодальных экспрессий, то во втором — стремление к постоянству, стабильности. Неменьшее разнообразие в сходстве и различии восприятия эмоций проявляется при попарном сравнении рейтингов идентификаций. Непредсказуемые, на первый взгляд, колебания оценок воспринимаемых состояний при изменении способов их выражения указывают на более сложную структуру кроссмодальных взаимодействий, не сводимую к отношениям категориально обезличенных средних по всей выборке.

Механизмы интеграции. Большинство гистограмм, иллюстрирующих точность оценок отдельных категорий эмоций в табл. 2, имеют вид двух- либо трехступенчатой «лесенки», что соответствует общим тенденциям, описанным выше: наименее адекватно воспринимаются отдельно экспонируемые интонации голоса, наиболее адекватно — их объединения с выражениями лица. Иначе идентифицируются гордость, удовольствие и страх. Состояние гордости по выражению лица оценивается точнее, чем по голосу и его объединению с мимикой; «лесенка» превращается в «вершину» (V < FV < F). Это единственный пример превосходства экспрессий лица не только над интонациями голоса, но и над их объединением с мимикой. При демонстрации состояний удовольствия и страха экспрессии лица, напротив, имеют наиболее низкие значения, а идентификации удовольствия и страха статистически неразличимы; «лесенка» сменяется «лощиной» (V = FV > F). Еще больше значимых отклонений обнаруживают парные сравнения точности оценок мимики лица (F) и интонаций голоса (V), с одной стороны, и экспрессий лица (F) и объединенных выражений (FV) — с другой. В первом случае при унимодальной демонстрации состояний развлечения, облегчения и печали точность идентификации сохраняется и остается ниже оценок объединенных экспрессий (V = F < FV); на «лесенке» образуется «нижнее плато». Во втором случае, в отличие от оценок интонаций голоса, состояния интереса, радости, раздражение, гнева и отвращения идентифицируются наблюдателями одинаково высоко (V < F = FV); «лесенка» приобретает «верхнее плато». В этой логике остаются лишь три состояния — удивление, тревога и горе, при идентификации которых усредненные отношения модальностей воспроизводятся буквально (V < F < FV).

С учетом статистического сходства и различий в распознавании уни- и бимодальных аффективных состояний одних и тех же категорий эмоций можно выделить типы конфигурации точности оценок, каждому из которых соответствует определенный механизм кроссмодальной интеграции, связывающий унимодальные экспрессии в единое целое (табл. 2). К типу I относится объединение путем взаимного дополнения унимодальных экспрессий в условиях их неравенства, когда больший вклад в оценку эмоции вносит выражение лица. Процесс генерируется на экспрессиях удивления, тревоги и горя. Нередко в публикациях подобный механизм рассматривается как основной или наиболее типичный, хотя по полученным данным это не всегда так. Чаще объединение происходит на основе доминирования выражений лица (тип II) и охватывает состояния интереса, радости, раздражения, гнева и отвращения. В этих случаях дополнительная модальность — интонация голоса — выступает в качестве фона, влияние которого на корректность общей оценки минимально. Тип III строится на паритете, при равноправном участии как мимики, так и голоса. Реализуется при экспозиции состояний развлечения, облегчения и печали. В основе механизма типа IV лежит доминирование интонаций голоса; влияние выражений лица проявляется слабо. Действие механизма распространяется на состояния удовольствия и страха. Это зеркальное отражение объединений II типа на более узком поле аффективных категорий. Рассмотренные сочетания унимодальных экспрессий вызывают либо эффект фасилитации — значимый рост точности оценок (типы I и III), либо его слабый след, намечающий тенденцию роста (типы II и IV). Из общей логики явно выпадает тип V, связанный с состоянием гордости. Доминированию экспрессий лица противостоит более слабое влияние голоса, достаточное, однако, для снижения точности идентификации бимодальных выражений. Возникает эффект противоположный фасилитации, указывающий на присутствие неконгруэнтного источника аффективной информации.

Во всех рассмотренных эпизодах унимодальные образующие используются в разной степени и ограничены содержанием эмоций. Каждая из них способна выполнять доминирующую, дополняющую, равноценную или сдерживающую функции в зависимости от возможностей альтернативы. Наиболее активную роль играют динамические экспрессии лица. Полученный результат, как правило, ведет к расширению и уточнению аффективной информации, а при наличии неконгруэнтных источников экспрессий вызывает снижение продуктивности восприятия аффективных состояний. Выделенные механизмы могут быть разбиты на подтипы, обладающие более тонкой спецификой. Например, для типа IV это — доминирование интонации голоса, по-разному проявляющееся при положительной (удовольствие) и отрицательной (страх) валентности. Возможна и более глубокая детализация по другим основаниям. Представление о множественности механизмов кроссмодальной интеграции подводит к вопросам организации их совместной работы, условиям актуализации, развития, взаимопереходов и др.

Таблица 2 / Table 2

Конфигурации точности оценок одних и тех же аффективных состояний натурщика по интонациям его голоса (V), экспрессиям лица (F) и их совместного выражения (FV). A, B, C, D — группы состояний, объединенных на основе сходства валентности и уровня активации

Configurations of the accuracy of assessments of the same affective states of the sitter based on the intonation of his voice (V), facial expression (F) and their joint expression (FV). A, B, C, D — groups of states combined based on the similarity of valence and activation level

|

Тип конфигурации / Configuration type

|

Опорные аффективные состояния / Basic affective states |

Вид на диаграмме / Type on the diagram

|

Кроссмодальные отношения / Crossmodal relationships |

Механизм интеграции / Integration mechanism |

|

|

|

I

|

удивление тревога (В) горе (С) / surprise , anxiety (B) despair (C |

“трехступенчатая лесенка” / “three-step ladder” |

V<F<FV |

Взаимодополнение / Complementarity

|

|

|

|

|

||||||

|

II

|

интерес радость (А) раздражение (D) гнев (D) отвращение / interest joy (A) irritation (D) anger (D) disgust |

“верхнее плато” / “upper plateau” |

V<F= FV |

Доминирование / Dominance |

|

|

|

|

||||||

|

III

|

развлечение (А) облегчение (А) печаль (С) / entertainment (A) relief (A) sadness (C)

|

“нижнее плато” / “lower plateau” |

V=F< FV

|

Паритет модальностей / Parity of modalities

|

|

|

|

|

||||||

|

IV

|

удовольствие (А) страх (В) / pleasure (A) fear (B)

|

“лощина” / “hollow” |

F<V= FV |

Доминирование интонаций / Dominance of intonation

|

|

|

|

V

|

гордость (А) / pride (A)

|

“вершина” / “top” |

V<F>FV |

Сдержанное доминирование экспрессий лица / Restrained dominance of facial expressions

|

|

|

Fig. 6. Average accuracy of identification of affective groups of vocal, facial, and multimodal expressions. A, B, C, D are affective groups, and Amb— ambivalent emotions; the numbers on top — the response rate; the numbers in the box on the right — the average values for each series, with an asterisk indicating significant differences. — multimodal expressions, — facial expressions, — vocal expressions

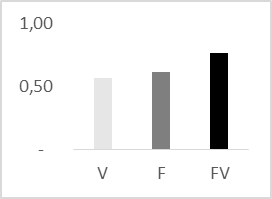

Роль валентности эмоций и степени активации. Строгого соответствия механизмов кроссмодальной интеграции определенным группам аффективных состояний, учитываемых методикой GERT, не обнаружено. Объединение унимодальных экспрессий группы А по-разному реализуется посредством механизмов II—IV типов, группы B — I—IV типов, группы С — II и III типов, группы D — только II типа. По-разному происходит интеграция и амбивалентных состояний: удивления — путем взаимного дополнения (тип I), интереса — через доминирование выражений лица (тип II).

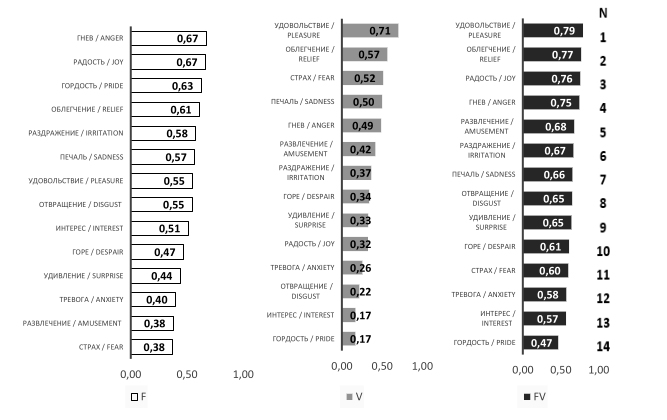

Особенности связи точности распознавания уни- и бимодальных выражений с валентностью эмоций показаны на рис. 6. Релевантные ответы наблюдателей распределены по статистически различным уровням точности и имеют похожие конфигурации. Нижний уровень образуют оценки вокальных экспрессий: для него характерна инвариантность средних значений распознавания как положительных (группа А), так и отрицательных (группы B, C, D) эмоций и резкое падение точности восприятия амбивалентных состояний. Идентификация лицевых и бимодальных экспрессий отличаются более высокими значениями и монотонным ростом оценок негативных состояний: B < C < D; снижение частоты релевантных выборов амбивалентных эмоций происходит более плавно. Усредненные идентификации бимодальных экспозиций отличаются от точности оценок унимодальных во всех аффективных группах, кроме D: для лицевых выражений UA = 456; UB = 672,5; UC = 644,5; Uamb = 401,1, р < 0,01; для вокальных: UA = 335; UB = 1096; UC = 1132,5; Uamb = 244,5, UD = 881,5, р < 0,01. При экспозиции каждой из унимодальных экспрессий в отдельности усредненные оценки группы B совпадают. При экспозиции лицевых и бимодальных экспрессий статистически значимые различия оценок группы D не найдены. Выделяются три тенденции динамики восприятия уни- и бимодальных состояний в зависимости от валентности: 1) средняя либо высокая точность распознавания положительных эмоций (группа A); 2) инвариантность либо монотонный рост точности оценок негативных состояний (B, C, D); 3) низкая и очень низкая точность оценок амбивалентных эмоций (Amb). Несмотря на очевидную связь способов кроссмодальной интеграции с семантическим содержанием (категорией) эмоций, их прямая зависимость от валентности не просматривается.

Более содержательной выглядит динамика точности идентификации аффективных групп, объединяющих эмоции с различной степенью активации: B (тревога/страх), C (печаль/горе), D (раздражение/гнев). В предшествующих работах (Барабанщиков, Суворова, 2021; 2022) мы обнаружили, что в условиях мультимодальной экспозиции прогнозируемый рост точности оценок с увеличением степени возбуждения действительно имеет место, но только по отношению к состояниям группы D. Этот же результат повторился в текущем исследовании при бимодальных экспозициях. Динамика восприятия унимодальных экспрессий оказалась иной. По интонациям голоса эмоции с высоким уровнем активации групп B и D воспринимаются более точно, а относящиеся к группе C — значимо хуже. По выражениям лица зарегистрирована прямая зависимость корректных оценок от уровня возбуждения групп C и D. Это означает, что в ходе кроссмодальной интеграции воспринимаемые отношения даже родственных эмоций подвергаются трансформациям, которые способны как усилить, так и ослабить то или иное унимодальное состояние, сохранить или купировать его эффективность. Открывается возможность использования оценок эмоции с разным уровнем возбуждения в качестве индикаторов динамики процесса кроссмодальной интеграции.

Когерентность унимодальных экспрессий. Как уже отмечалось, при демонстрации одного и того же эмоционального состояния суммарная точность идентификации унимодальных экспрессий превышает точность идентификации бимодального выражения (V + F > FV). Полнота аффективной информации в рамках общего целого увеличивается, но не настолько сильно, как это можно было бы ожидать. В процессе кроссмодальной интеграции часть специфических проявлений унимодальных эмоций не используется. Объединенный экспрессивный потенциал теряет до 40%. Неаддитивность отношений имеет место при идентификации каждой категории эмоции. В зависимости от их содержания диапазон «потерь» варьирует от 12% (развлечение)– до 59% (гордость). Все это говорит о том, что точность идентификации унимодальных состояний зависит не только от собственных проявлений разнокачественных экспрессий, но и от их совместимости или когерентности.

Проявления разномодальных выражений одной и той же эмоции рассматриваются как когерентные, если непосредственно участвуют в кроссмодальной интеграции, а их влияние превышает 5% — порог частоты выбора. Характер совокупности соотношений когерентных и некогерентных экспрессий можно проследить по гистограммам структур категориальных полей уни- и бимодальных состояний (рис. 4). Они разделены пунктирной линией: сверху располагаются оценки некогерентных, снизу — когерентных выражений. На уровне дополнительных эмоций в большинстве случаев некогерентными являются голосовые экспрессии, даже когда показывают относительно высокую частоту выбора. При идентификации, например, радости это горе, страх, печаль; отвращения — гнев и удовольствие. Содержательно преобладают отрицательные либо амбивалентные эмоции. Некогерентные лицевые экспрессии в целом представлены более низкими оценками. При идентификации радости это удивление; печали — облегчение, отвращение, тревога. Здесь также преобладают отрицательные и амбивалентные состояния.

Плотность когерентных связей обусловлена категорией эмоции (табл. 3). Высокая плотность когерентных связей отмечена в бимодальных экспрессиях тревоги, развлечения, радости, удивления, интереса и горя, низкая « тревоги, гнева, печали и раздражения; предельно низкая — гордости. Среднее значение коэффициента когерентности по оценке точности целевых экспрессий — 73%. Зарегистрирована тенденция роста плотности когерентных связей с увеличением степени возбуждения эмоций группы С и обратная тенденция для группы В.

Таблица 3 / Table 3

Плотность когерентных связей бимодальных (лицо/голос) состояний (Ксоg)

The density of coherent connections of bimodal (face/voice) states (Ксоg)

|

Эмоция / Emotion |

FV |

V |

F |

V + F |

Ксоg, % |

|

Гордость / Pride |

0,47 |

0,17 |

0,63 |

0,46* |

59% |

|

Радость / Joy |

0,76 |

0,32 |

0,67 |

0,99 |

83% |

|

Развлечение / Amusement |

0,68 |

0,42 |

0,38 |

0,80 |

88% |

|

Удовольствие / Pleasure |

0,79 |

0,71 |

0,55 |

1,26 |

68% |

|

Облегчение / Relief |

0,77 |

0,57 |

0,61 |

1,18 |

75% |

|

Интерес / Interest |

0,57 |

0,17 |

0,51 |

0,69 |

84% |

|

Удивление / Surprise |

0,65 |

0,33 |

0,44 |

0,77 |

85% |

|

Тревога / Anxiety |

0,58 |

0,26 |

0,40 |

0,66 |

62% |

|

Страх / Fear |

0,60 |

0,52 |

0,38 |

0,89 |

71% |

|

Горе / Despair |

0,61 |

0,34 |

0,47 |

0,81 |

85% |

|

Печаль / Sadness |

0,66 |

0,50 |

0,57 |

1,07 |

65% |

|

Отвращение / Disgust |

0,65 |

0,22 |

0,55 |

0,77 |

77% |

|

Раздражение / Irritation |

0,67 |

0,37 |

0,58 |

0,95 |

65% |

|

Гнев / Anger |

0,75 |

0,49 |

0,67 |

1,16 |

63% |

|

Среднее / Average |

0,66 |

0,39 |

0,53 |

0,91 |

73% |

Примечание: Ксоg = 1 - , где V, F, FV — точность идентификации вокальной, лицевой и бимодальной экспрессий.

Note: Ксоg = 1 - , V, F, FV — accuracy of identification of vocal, facial and bimodal expressions.

Бимодальная структура категориальных полей. Воспринимаемое содержание унимодальных эмоциональных состояний человека представлено структурами категориальных полей, которые наряду с целевой экспрессией — аффективным ядром — включают оценки ассоциированных выражений, имеющих с ней общие признаки. В среднем на каждую категорию приходится 4—5 дополнительных эмоций, хотя в отдельных случаях их может быть семь (гордость) или одна (гнев) (рис. 4). Категориальные поля биполярных состояний отличаются от унимодальных значительным сокращением состава дополнительных признаков: в среднем до 2,28 аффективных категорий на каждую целевую эмоцию. Объем сокращений неравномерен и зависит от валентности. Периферия категориальных полей аффективной группы А (с учетом идентификации гордости) сужается в 3,2 раза по отношению к совокупному объему категорий, аффективных групп B, C, D — в 1,7 раза, амбивалентных эмоций — в 2,25 раза.

Оценки иррелевантных состояний кратно ниже релевантных и тесно связаны с расположением на круговой шкале Швейцарского колеса относительно целевой категории. Как правило, выбираются состояния смежные или соседствующие с целевыми. Например, для тревоги это страх и удивление (первый уровень сходства), горе и интерес (второй уровень) и т. п. Соотношение оценок предшествующих и следующих за данной эмоцией по часовой стрелке может носить как симметричный, так и асимметричный характер.

Среди особенностей идентификации иррелевантных (дополнительных) состояний целесообразно отметить следующие: 1) чем ближе к целевой категории локализуются экспонируемые эмоции, тем выше вероятность ее выбора (гнев, печаль, тревога); 2) на отдельных участках Колеса средняя частота иррелевантных ответов не зависит от расположения цели (гордость, удивление, горе) и может носить циклический характер: подъем частоты выбора соседних или смежных эмоций, ее спад и снова подъем (тревога, страх, отвращение); 3) для единичных категорий дополнительных эмоций возможен значительный рост частоты ответов на фоне низких показателей смежных и/или соседних состояний (радость, удивление, тревога); 4) динамика оценок дополнительных эмоций по выражениям лица чаще соответствует оценкам бимодальных состояний и противоречит динамике вокальных проявлений. Перечисленные особенности и их сочетания обнаруживаются на всех модальностях аффективных состояний, но в каждой из них имеют свою специфику. В отличие от унимодальных, категориальные поля бимодальных состояний имеют четко выраженный устойчивый анизотропный контур. Различимость сигнала по отношению к шуму (источникам дополнительной аффективной информации) максимальна. Очевидно, что мультимодальные выражения и восприятия эмоциональных состояний человека наиболее полно соответствуют эволюционным и социокультурным требованиям эффективности межличностного взаимодействия и по отношению к унимодальным экспрессиям первичны.

Использование голоса либо лица в качестве основной опоры кроссмодальной интеграции носит функциональный характер. Это касается и целевых, и дополнительных экспрессий (рис. 4). Идентификация демонстрируемого страха как страха (целевое выражение) больше опирается на голосовые интонации. Проявление страха в контексте удивления полностью базируется на экспрессиях лица, а в контексте состояния горя в равной степени на обеих образующих. Наряду с содержанием воспринимаемой эмоции, важным является место, занимаемое ею в мультимодальной структуре категориального поля.

Несмотря на общность состава унимодальных категориальных полей одного и того же аффективного состояния, их структуры качественно различны и по-разному участвуют в процессах периферической кроссмодальной интеграции. При разнообразии рассмотренных отношений и наличии статистически значимых различий, они не подходят под типы интеграции, описанные выше. Более того, возможен диссонанс между восприятием целевых и нецелевых экспрессий одной и той же категории.

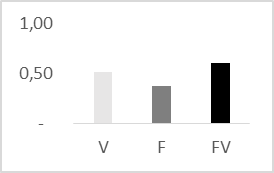

|

Fig. 7. The frequency of additional selections of group B states depending on the category of target expression under conditions of unique and bimodal exposure of voice (V), face (F) and face and voice (FV)

На рис. 7 показаны соотношения частоты выбора целевого и дополнительного эмоциональных состояний группы D (раздражение/гнев) при экспозициях выражений лица, интонаций голоса и объединенных экспрессий в зависимости от расположения цели. В первых двух фрагментах слева представлены отношения целевой и смежной (1-й уровень сходства) дополнительной эмоции, в двух последующих — дополнительные эмоции в структуре категориальных полей отвращения и страха. За исключением релевантных идентификаций (совпадения оценок раздражения и гнева с целевыми категориями) интеграция унимодальных экспрессий не усиливает, а ослабляет или исключает бимодальные проявления, а характерная для оценок целевых эмоций зависимость от степени возбуждения пропадает.

Согласно экспериментальным данным мультимодальный образ эмоции каждый раз создается заново. События на периферии категориального поля определяются целевым состоянием. Меняется ядро — меняется и ассоциированное содержание и его отношения на периферии категориальных полей. Действие механизмов кроссмодальной интеграции, обнаруживаемых при идентификации целевых эмоций, на периферии не зарегистрированы. Место сборки и оператор объединенных аффективных состояний соотносимы с ядрами категориальных полей. Дополнительное содержание, за исключением сходства экспрессий первого уровня, воспринимается как фоновое.

Совокупные результаты указывают на высокую избирательность и вариативность кроссмодальной интеграции, гибкое использование разнокачественных идентификационных признаков и динамики их функциональных объединений, задаваемых целевой категорией. Безусловным достижением кроссмодальной интеграции является не только увеличение точности восприятия аффективных состояний, но и упрощение его содержания, снижение уровня общей экспрессивности. Образ эмоции очищается от второстепенных некогерентных проявлений, включая в свою конфигурацию все то, что приводит к оптимально возможному перцептивному результату.

Процесс кроссмодальной интеграции аффективных выражений представляется более дифференцированным и тонким, чем можно было бы ожидать. Он не сводится к прямому взаимодействию сенсорных систем, в том числе зрительной и акустической, хотя и развертывается на их основе. Важным является предметное (категориальное) содержание экспрессий и логика объединения разномодальных впечатлений о состоянии человека, реализующаяся в процессах коммуникации (Барабанщиков, 2009; 2012a; 2012б; 2016).

Выводы

- На уровне медианных значений точность идентификаций бимодальных экспрессий эмоциональных состояний натурщиков превышает оценки как выражений лица, так и интонации голоса, демонстрируемых в отдельности, но остается меньше их совокупности. Наиболее активную роль в структуре бимодальных состояний играет мимика лица, дополненная динамикой взора и губ. В целом этот результат соответствует данным, полученным разными авторами в сходных условиях эксперимента. Доминирование выражений лица над интонациями голоса выглядит как универсальный способ объединения разнокачественных образующих.

- Дифференцированный анализ кроссмодальных отношений, выполненный на уровне категорий эмоций, показал их неоднородность, высокую избирательность и вариативность. Конфигурации точности идентификаций одного и того же состояния при смене модальности меняются. Наибольшие изменения связаны с эмоциями, имеющими положительную валентность. Колебания оценок точности не сводятся к отношениям категориально обезличенных средних, указывая на более сложную структуру межмодальных отношений.

- Выделены пять типов локальных конфигураций точности идентификации уни- и бимодальных аффективных состояний, зависящие от содержания (категории) эмоций, и соответствующие им механизмы кроссмодальной интеграции: 1) взаимодополнение унимодальных экспрессий; 2) доминирование выражений лица; 3) паритет — равноправное участие как мимики, так и голоса; 4) доминирование интонации; 5) сдержанное доминирование экспрессий лица. Строгого соответствия выявленных механизмов аффективным состояниям разной валентности не обнаружено.

- В процессе кроссмодальной интеграции часть унимодальных проявлений не используется. В зависимости от содержания эмоции объединенный экспрессивный потенциал теряет до 40%. Идентификацию бимодальных состояний обеспечивают когерентные разномодальные экспрессии одного и того же состояния. Наиболее часто некогерентными оказываются вокальные экспрессии с отрицательной валентностью.

- Бимодальные категориальные поля отличаются от унимодальных более высокой точностью идентификации целевой эмоции, кратным сокращением состава и интенсивности аффективной периферии. Бимодальный образ эмоции ограничен содержанием, которое ведет к оптимально возможному перцептивному результату. Действия механизмов кроссмодальной интеграции, обнаруживаемые при идентификации целевых эмоций, на периферии категориальных полей не зафиксированы.