Введение

Данная работа посвящена специфике восприятия мультимодальных эмоциональных состояний человека при внешних ограничениях сенсорных данных, получаемых по одному из параллельных каналов информации. Это, например, случай беседы с человеком, лицо которого прикрыто медицинской маской, массивными солнцезащитными очками или специальными приборами, укрепленными на голове. Его волнения, изменение позиции или отношения проявляются в мимике открытой части лица и, одновременно, в интонациях голоса. При идентификации состояния коммуниканта складывается ситуация, когда, с одной стороны, ограничивается объем визуальной информации, заключенной в лицевых экспрессиях, с другой — имеет место достаточная информация подобного содержания, получаемая по акустическому каналу (интонации голоса), с третьей — экспрессивные возможности модальностей неодинаковы и стремятся к объединению. Предсказать результат восприятия в, казалось бы, несложной жизненной ситуации весьма проблематично: возможность компенсации потерь лицевых экспрессий интонациями речи ограничена сопоставимостью модальностей. Возникают новые качества выражения и восприятие эмоций, не характерные для каждой из образующих в отдельности (унимодально).

Визуальное восприятие выражения лица при экспозиции его частей реализуется благодаря конфигурационным связям и интерполяции. Общим условием воссоздания целостного впечатления является соотносительность частей (Kellman, 2003), которая выполняется для каждой из половин лица. Перцептивный процесс опирается на коммуникативный опыт наблюдателя, контролируется схемой выражения полностью открытого лица и подчиняется принципам организации зрительного поля (Барабанщиков, 2009, 2012а, 2012б). При мультимодальном восприятии эти условия дополняются взаимодействием каналов различной модальности.

Вклад верхней и нижней половин лица в оценку состояния человека определяется категорией эмоции. В исследованиях с использованием частичной окклюзии лица чаще отмечается преимущество (доминанта) верхней части, хотя результаты не всегда согласуются друг с другом. Показано, что глаза и брови образуют диагностическую зону выражений гнева, страха и печали, нижняя часть лица более важна для распознавания радости и отвращения (Барабанщиков, Малкова, 1988; Boucher, Ekman, 1975; Wegrzyn et al., 2017). Эмоция гнева в ряде исследований хуже идентифицируется при закрытой нижней части лица, в других — опирается на диагностические признаки верхней половины. Состояние удивления может менять доминантную часть или слабо распознаваться в условиях окклюзии (Calder et al., 2000; Smith et al., 2005; Sullivan, Ruffman, Hutton, 2007; Kotsia, Buciu, Pitas, 2008; Bombari et al., 2013; Calvo, Nummenmaa, 2016).

В работах периода пандемии показано, что маски, закрывающие нижнюю половину лица, ухудшают точность распознавания эмоций гнева, печали, отвращения и радости, но в меньшей степени влияют на эмоции, распознаваемые по верхней части лица (Carbon, 2020; Ruba, Pollak, 2020; McCrackin, Ristic, 2022, 2024; Libby, Scarince, 2025; Grahlow, Rupp, Derntl, 2022).

В исследованиях движений глаз при распознавании негативных эмоций участники систематически чаще и дольше смотрели на глаза и брови, тогда как для положительных эмоций фокус внимания смещался к нижней части лица (Schurgin, 2014; Bombari et al., 2013).

Полученные результаты расширяют представления о диагностических зонах лица и доказывают, что восприятие эмоций при частичной окклюзии зависит не только от степени информативности отдельных частей лица, но и от характера их отношений.

При исследовании восприятия динамических эмоциональных состояний методом окклюзии в центре внимания оказываются влияние отдельных каналов информации, специфика визуальной и акустической составляющих, закономерности кросс-модальной интеграции. Вклад лица и голоса по-разному распределяется в зависимости от конфигурации, открытости отдельных частей лица, характеристик лицевой и просодической образующих, контекста коммуникативной ситуации и других факторов.

Роль отдельных частей лица в распознавании мультимодальных состояний также обусловлена содержанием эмоции. При окклюзии процессы мультимодальной интеграции не просто усиливаются, но и перестраиваются в зависимости от того, какая часть лица оказывается доступной. Кросс-модальная интеграция визуальной и акустической модальности зависит от степени информативности каждого канала: если визуальная информация искажена или частично скрыта, возрастает значимость голосовых параметров, и наоборот. Конгруэнтность лицевых и просодических образующих усиливает точность распознавания эмоций и частично компенсирует функциональные потери одного из каналов. Отвращение, печаль и гнев при окклюзии нижней части лица идентифицируются хуже интонаций голоса, которые помогают различить валентность эмоции и уровень возбуждения, но не способны полностью заменить недостающие мимические проявления. При окклюзии верхней части наблюдатели чаще ошибочно воспринимают страх как удивление, а печаль — как нейтральное состояние, несмотря на ясные голосовые интонации (Kawahara, Tanaka, 2025; Jackson et al., 2024; Gao et al., 2026).

Для эмоций радости и отвращения, мимические признаки которых локализованы в нижней половине лица, несмотря на сопровождение вокальной экспрессии, окклюзия нижней части резко ухудшает идентификацию. Улыбка, подъем уголков рта, действия круговой мышцы рта и поднятие верхней губы несут основную долю информации о радости. Отвращение, выражающееся в поднятии верхней губы, сморщивании носа и асимметричных сокращения мышц носогубной области, представляют собой характерные признаки, которые трудно компенсировать за счет вокальной составляющей. Хотя голос в состоянии передать валентность и интенсивность, он не способен заменить визуальные признаки, определяющие специфичность именно этой эмоции. В выражении состояния гнева одинаково задействованы как верхняя, так и нижняя части лица. При закрытой нижней части голос частично компенсирует отсутствие визуальной информации, а оценки в большей степени включают отсутствующие эмоции отвращения, печали или страха.

Интонации голоса становятся главным источником информации, когда закрыта нижняя часть лица, но остаются второстепенными при окклюзии верхней. Динамика эмоциональных выражений также помогает компенсировать отсутствующие визуальные признаки. Микродвижения глаз, ритм и фазы моргания, динамические изменения тонуса бровей и их согласование с вокальными параметрами позволяют частично восстанавливать эмоциональный контент, включая случаи искажения нижней части лица. Эффективность компенсации зависит от возраста наблюдателя: молодые участники более чувствительны к динамическим подсказкам выражения лица, тогда как пожилые полагаются на голос (Garrido-Vásquez et al., 2018; Leitner et al., 2022; Bartolini et al., 2026).

Кросс-модальная интеграция в условиях окклюзии лица не выглядит универсальной и определяется объективными характеристиками стимула, особенностями коммуникативной ситуации и перцептивными возможностями наблюдателя. Эффективное распознавание базовых эмоций опирается на доминантность экспрессий одной из половин лица либо на согласования мимических проявлений смежных частей, динамика распределяет их вклад во времени и усиливает взаимодействия. В зависимости от содержания эмоции и способа окклюзии лица отношения лицевой и просодической образующих организуются по-разному. За восприятием парциальных экспрессий стоит восприятие выражения лица в целом.

Пример мультимодальной ситуации, описанный в начале статьи, предполагает взаимодействие ряда разнонаправленных и разномерных детерминант, исключающих однозначность идентификации аффективных состояний. Пытаясь разобраться в их отношениях, мы провели эксперименты, в которых выражения бимодальных эмоций (мимика + интонации голоса) оценивались наблюдателями при окклюзии лица. Цель исследования: сравнительный анализ продуктивности восприятия бимодальных аффективных состояний человека в условиях полностью (целого) и частично открытого лица (верхняя либо нижняя часть). Нас интересовали точность идентификации экспрессий целого и частично открытого лица, отношения оценок парциальных экспрессий, роли валентности и уровня активации.

Материалы и методы

В основу исследования положен Женевский тест распознавания эмоций (Geneva Emotion Recognition Test) — GERT, разработанный для изучения выражения и идентификации мультимодальных аффективных состояний человека (Scherer, 2005; Schlegel, Scherer, 2017; Schlegel, Grandjean, Scherer, 2014). Российская апробация методики выполнена нами ранее (Барабанщиков, Суворова, 2020, 2021, 2023). GERT включает расширенный набор аудиовидеоизображений ключевых эмоций, созданный при участии профессиональных актеров, специально подготовленных по методу переживания К.С. Станиславского.

Стимульный материал содержит мимику, жесты, движение глаз и головы, а также псевдолингвистические фразы, несущие интонации выражаемого состояния. Аудиотреки различаются тембром, ударениями, паузами, темпом и тоном речи актеров.

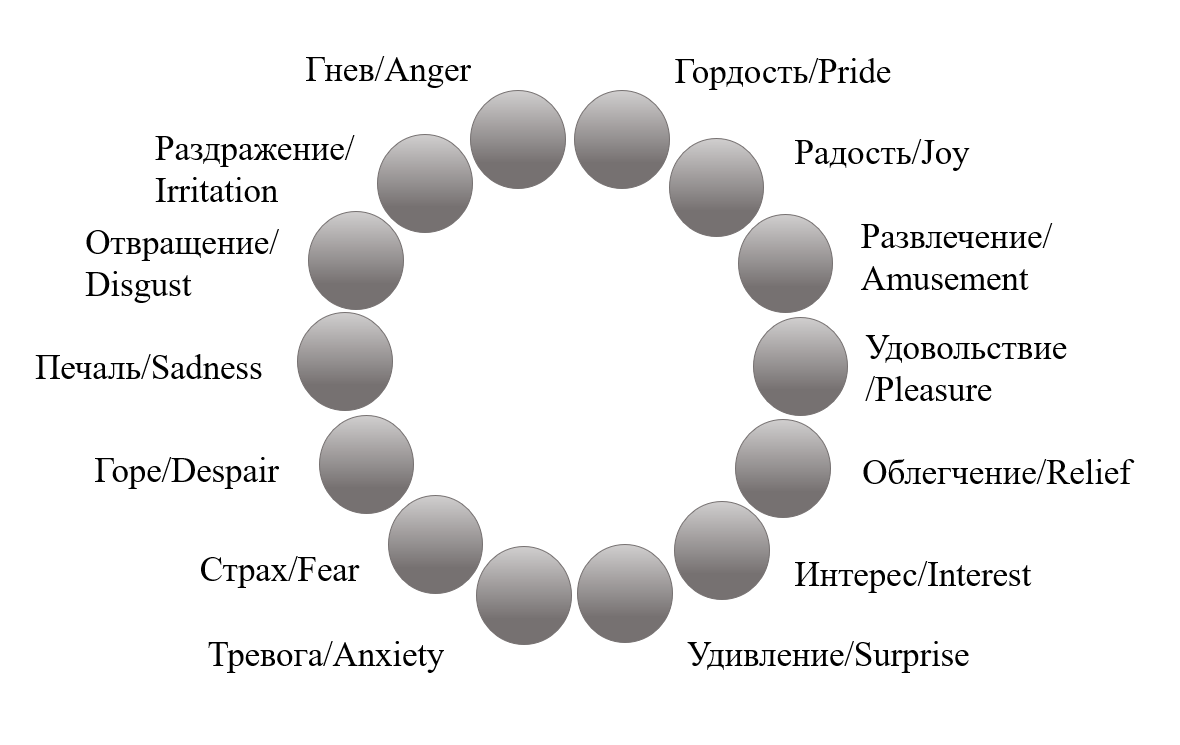

Эксперимент состоял из трех серий. В первой участникам предъявлялись оригинальные аудиовидеоизображения эмоциональных состояний натурщиков-актеров, во второй — эти же ролики с прикрытой верхней частью лица, в третьей — прикрытой нижней частью. Требовалось определить содержание воспринятой эмоции, используя интерактивное изображение «Женевского колеса эмоций» — объединения в круг 14 категорий аффективных состояний, ранжированных в зависимости от их валентности и степени возбуждения (рис. 1). Понятийный конструкт включал четыре групповые и три самостоятельные эмоции. Гордость, радость, развлечение, удовольствие и облегчение представляли состояния с положительной валентностью (группа А). Состояния с отрицательной валентностью разделялись на пары однотипных (родственных) эмоций, различавшихся степенью возбуждения. В группу B входили тревога и страх, в группу C — печаль и горе, в группу D — раздражение и гнев. Амбивалентные эмоции интереса и удивления вместе с отвращением полагались как независимые. В силу внутреннего устройства Колеса демонстрируемые эмоциональные состояния не только разделялись на дискретные единицы — категории, но и пересекались или соседствовали по линиям сходной валентности либо близкой степени возбуждения (активации).

Fig. 1. Geneva Emotion Wheel

Участники исследования: 120 студентов и аспирантов московских вузов, в возрасте 18—52 ± 11 лет, с нормальным или корректируемым зрением. Испытуемые были разделены на три независимые группы по 40 человек: первая группа включала 25 женщин и 15 мужчин, вторая — 25 женщин и 15 мужчин, третья — 27 женщин и 13 мужчин.

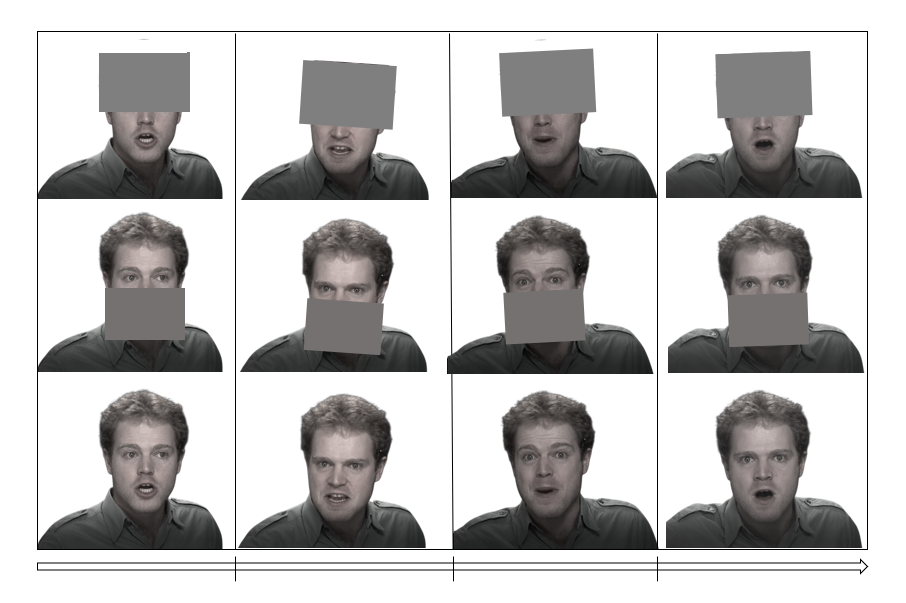

Процедура. Техническая реализация эксперимента осуществлялась на электронных платформах Limesurvey, Google Sheets. Эксперименты проводились в лабораторной либо дистантной формах. В лаборатории Института экспериментальной психологии МГППУ использовалась платформа-моноблок PowerCool P2151BK с дисплеем диагональю 21,5, разрешение 1920 × 1080 px. Дисплей располагался на расстоянии около 60 см от лица испытуемого. Угловые размеры видеоизображений составляли 18 × 24°, лица —– 8 × 10°. Стимульный материал для второй и третьей серий эксперимента создавался в программе Adobe Premiere pro 2024. Верхняя/нижняя половина лица актера на оригинальных видеоизображениях прикрывалась серым прямоугольником, расположенным параллельно линии глаз, повторяющим движения головы (рис. 2). В верхней половине под маской скрывалось основание носа, глаза, брови и лоб, в нижней — часть носа, рот, щеки и подбородок. Просодические экспрессии экспонировались через наушники Sennheiser HD555 (15—28 кГц, 113 дБ), Canyon CNR-HS01N (20—20 кГц, 106 дБ), Logitech H111 (20—20 кГц, 100 дБ). Громкость и качество звука настраивались испытуемыми индивидуально. Удаленное исследование проводилось посредством направления URL-ссылки на электронную почту участника при наличии у него необходимого оборудования и возможности контроля корректного прохождения эксперимента (Барабанщиков, Суворова, 2022).

После знакомства с требованиями инструкции и выполнения предварительных проб участникам последовательно предъявлялись 83 аудиовидеозаписи эмоциональных экспрессий десяти актеров — 5 мужчин и 5 женщин, средний возраст — 37 лет. Каждая экспозиция демонстрировалась один раз на 3—5 секунд. Переход к новой экспозиции осуществлялся автоматически после выбора категории (касания соответствующей кнопки) на круговой шкале эмоций.

Рис. 2. Раскадровка видеоизображения лица натурщика, выражающего гнев

Fig. 2. The storyboard of the sitter's face under experimental conditions

Анализ данных. Рассчитывались показатели эффективности распознавания бимодальных (мимика лица + интонации голоса) выражений лица, их отношения и зависимости. Использовался пакет программ IBM SPSS Statistics 22.0. Применялись: однофакторный анализ ANOVA (F-критерий), критерий Манна-Уитни (U-критерий), критерий Краскела-Уоллиса (H-критерий) с уровнем значимости p < 0,05, непараметрический коэффициент корреляции — Ро Спирмена. Анализировались точность оценок и характер ответов, их зависимость от экспозиции целого либо части лица, аффективного содержания, валентности, степени возбуждения эмоции, и других обстоятельств.

Основные результаты

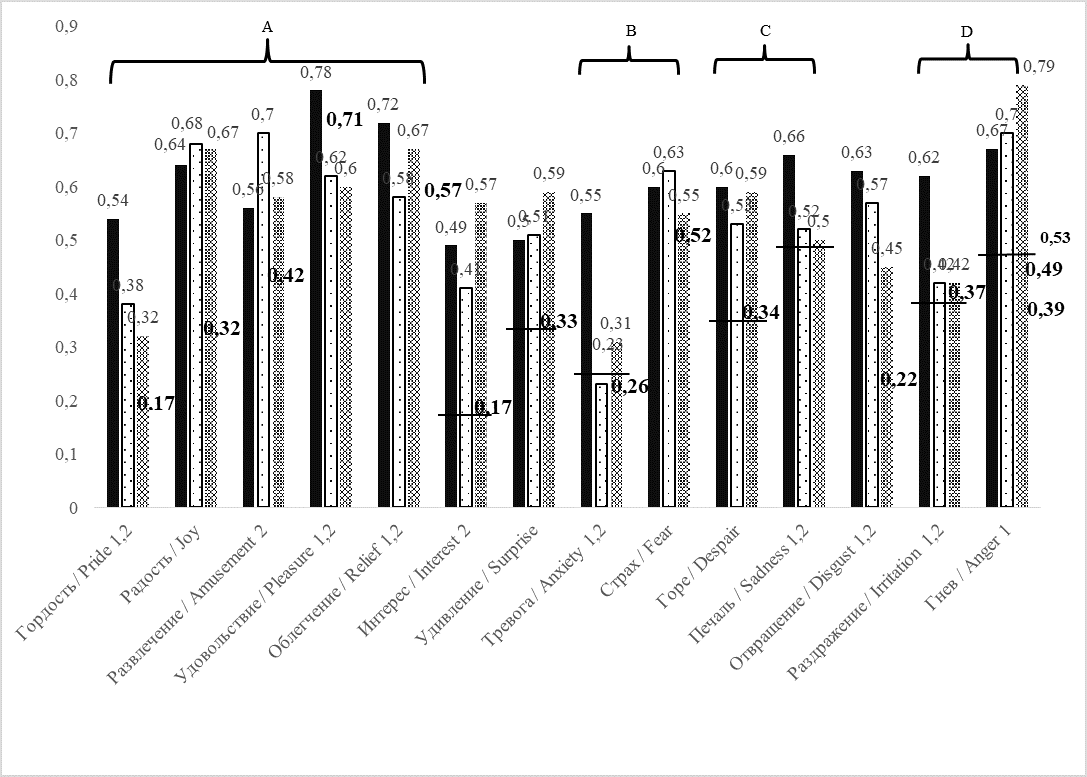

Рис. 3. Частота релевантного выбора бимодальных состояний при экспозиции экспрессий целого лица, его нижней и верхней частей.

A, B, C, D — аффективные группы. — экспрессии целого лица; — экспрессии нижней части; — экспрессии верхней части. Цифрой 1 отмечены значимые различия оценок полностью открытого лица и его верхней части, 2 — полностью открытого лица и его нижней части. Пунктирные линии обозначают уровни средней точности идентификации эмоций в контролируемых условиях экспозиции, горизонтальные отрезки — оценки просодий, числовые значения выделены жирным шрифтом

Fig. 3. The frequency of distribution of the relevant choice of part-whole expressions’ perception. A, B, C, D — affective groups. — expression of the whole face; — expression of the lower part; — expression of the upper part. The number 1 indicate significant differences between a fully open face and its upper part, 2 — a fully open face and its lower part. The dotted lines represent levels of average identification accuracy of emotions for controlled exposition conditions, horizontal segments are estimates of prosody, numeric values are shown in bold

Релевантные оценки мультимодальных состояний представлены на рис. 3. При экспозиции экспрессий полностью открытого лица средняя точность ответов по группе составила Мо = 0,61, SD = ± 0,08. Лучше всего распознаются эмоции удовольствия (0,78), облегчения (0,72), гнева (0,67) и печали (0,66); ниже среднего уровня — проявления развлечения (0,56), тревоги (0,55), гордости (0,54), удивления (0,5) и интереса (0,49).

При экспозиции экспрессий нижней половины лица средняя точность релевантных ответов составила Мн = 0,53, SD = ±0,13. Наиболее адекватно распознаются эмоции развлечения (0,7), гнева (0,7) и радости (0,68), менее точно — раздражение (0,42), гордость (0,38), интерес (0,41) и тревога (0,23).

При экспозиции экспрессий верхней половины лица средняя точность релевантных ответов составила Мв = 0,54, SD = ±0,13. Наиболее корректно распознаются эмоции гнева (0,79), радости (0,67) и облегчения (0,67), менее точно — отвращение (0,45), раздражение (0,42), гордость (0,32) и тревога (0,31).

Точность распознавания экспрессий полностью открытого лица по отношению к его нижней части значимо выше для эмоций гордости (h = 32,9, p < 0,05), удовольствия (f = 4,36, p < 0,05), облегчения (h = 39,71, p < 0,05), тревоги (h = 30,43, p < 0,05), печали (h = 17,46, p < 0,05), отвращения (h = 31,6, p < 0,05) и раздражения (h = 33,88, p < 0,05), значимо ниже — для эмоции развлечения (h = 24,42, p < 0,05).

Статистически значимые различия между средними оценками экспрессий по всей выборке целого лица и каждой из его частей отсутствуют (U = 25,5, p = 0,64 для целой и верхней части; U = 11, p = 0,97 для целой и нижней части).

Точность распознавания экспрессий полностью открытого лица по отношению к его верхней части значимо выше для эмоций гордости (h = 24,43, p < 0,05), удовольствия (f = 4,82, p < 0,05), облегчения (h = 26,14, p < 0,05), тревоги (h = 39,55, p < 0,05), печали (h = 23,75, p < 0,05), отвращения (h = 17,08, p < 0,05) и раздражения (h = 30,74, p < 0,05), но значимо ниже для эмоции интереса (f = 3,64, p < 0,05).

Статистически значимые различия точности оценок состояний по экспрессиям нижней и верхней половин лица установлены для эмоций развлечения (h = 17,91, p < 0,05) и интереса (f = 3,28, p < 0,05).

Обсуждение результатов

Соотношение экспрессий целого и части лица в оценках бимодальных аффективных состояний. В зависимости от сходства и различия точности идентификации эмоциональных выражений натурщиков совокупные данные распределились по нескольким группам (табл. 1).

(1) «Целое больше каждой из частей». Точность идентификации бимодальных состояний по выражению целого лица значимо выше соответствующих выражений каждой из его половин при экспозиции эмоций гордости, удовольствия, тревоги, печали, раздражения. Доля категорий — 36%. Превышение средних значений точности ответов по выборке — в 1,47 раза; максимально высокий результат — в 2 раза (экспозиция тревоги). В данной группе оценки эмоций полностью открытого лица представлены не только высокими, но и средними значениями. Решающей является относительная величина идентификаций; точность экспрессий части лица оценивается еще ниже. Статистически значимые различия в идентификации эмоций по верхней и нижней половинам лица во всех случаях отсутствуют.

(2) «Целое равно каждой из частей». Точность восприятия бимодальных состояний целого лица совпадает с оценками его и верхней, и нижней половин: радость, страх, горе. Доля категорий — 21%. Результаты оценок выражений открытого лица колеблются около средних значений по выборке. Статистически значимые различия в идентификации эмоций по верхней и нижней половинам лица не зарегистрированы.

(3) «Целое больше/равно одной из частей». Точность идентификации бимодальных экспрессий целого лица значимо выше либо равна идентификации экспрессий одной из частей. При экспозиции облегчения бимодальные выражения целого лица оцениваются точнее его нижней части, не различаясь с верхней. При экспозиции отвращения отношение обратное: точность идентификации экспрессии целого совпадает с оценками экспрессий нижней части лица, но значимо выше верхней. Доля категорий — 14%. Оценки выражений открытого лица располагаются выше средних по выборке.

(4) «Целое меньше/равно одной из частей». Точность идентификации бимодальных состояний целого лица значимо ниже либо равна идентификации состояний одной из частей в следующих случаях. Развлечение — наиболее точно оценивается по нижней половине лица, оценки целого и верхней половины совпадают. Интерес, удивление и гнев, напротив, более высоко оцениваются по верхней половине, оценки экспрессии целого и нижних половин лица неразличимы. Понижение корректности ответов по отношению к групповому среднему минимально; наибольшее падение точности идентификации выражений полностью открытого лица — в 1,24 раза (экспрессии удивления и интереса). Доля категорий — 29%.

(5) «Целое меньше каждой из частей». Версия о превышении точности оценок экспрессий и верхней, и нижней половин лица над целым не получила подтверждения.

Таблица 1 / Table 1

Соотношения точности оценок экспрессий целого и частей одного и того же лица в зависимости от содержания мультимодальных аффективных состояний

The ratio of the expressions' accuracy of the whole and parts of the same person, depending on the content of multimodal affective states

|

Тип отношений / Relationship type |

Аффективные состояния / Affective states |

Точность оценок / Accuracy of estimates |

Доли категорий / Category shares |

||

|

Целое / Whole (Мо ± SD) |

Нижняя часть / Lower part (Мн ± SD) |

Верхняя часть / Upper part (Мв ± SD) |

|||

|

Целое больше каждой из частей / Whole is larger than each of the parts |

гордость, удовольствие, тревога, печаль, раздражение / pride, pleasure, anxiety, sadness, irritation |

0,63 ± 0,08 |

0,43 ± 0,13 |

0,43 ± 0,1 |

36% |

|

Целое равно каждой из частей / Whole is equal to each of the parts |

радость, страх, горе / joy, fear,despair |

0,61 ± 0,02 |

0,61 ± 0,06 |

0,6 ± 0,05 |

21% |

|

Целое больше/равно одной из частей / Whole is larger than/equal to one of the parts |

облегчение, отвращение / relief, disgust |

0,68 ± 0,05 |

0,58 ± 0,01 |

0,56 ± 0,11 |

14% |

|

Целое меньше/равно одной из частей / Whole is less than/equal to one of the parts |

развлечение, интерес, гнев, удивление / amusement, interest, anger, surprise |

0,56 ± 0,07 |

0,58 ± 0,13 |

0,63 ± 0,09 |

29% |

|

Целое меньше каждой из частей / Whole is smaller than each of the parts |

не зарегистрировано / not registered |

- |

- |

- |

- |

Согласно полученным данным продуктивность восприятия бимодальных аффективных состояний, представленная отношениями точности идентификации, неоднородна, зависит от содержания эмоций и расположения открытой области лица. Повышенная экспрессивность выражений полностью открытого лица ожидаемо проявляется в более высокой точности идентификации экспрессий целого по сравнению с каждой из его частей, наибольшем количестве категорий эмоций, превосходящих оценки частей (50% vs 29%), и отсутствии данных о более точной идентификации экспрессий каждой из частей одного и того же лица по отношению к целому. В отличие от восприятия статичных и унимодальных выражений преимущества идентификации открытого лица не являются безусловными. В разной степени они уравниваются сходством оценок бимодальных выражений целого и обеих частей (21% категорий), каждой из них в отдельности (14%), а также превышением точности идентификации отдельных частей над целым (29%).

Средние оценки экспрессий целого и каждой из частей лица всех экспонируемых состояний статистически неразличимы (U = 25,5, p = 0,64 для целого и верхней части; U = 11, p = 0,97 для целого и нижней части). Общее смещение рассогласования средних значений в сторону целого составляет 12—13%.

В условиях бимодального выражения эмоционального состояния человека уровни продуктивности восприятия экспрессий открытого лица и каждой из его половин, несмотря на недоступность значительных объемов лицевой информации, сближаются. Максима гештальтпсихологии, подчеркивающая приоритет целого над частью, выглядит ограниченной. Усиливаются экспрессивные возможности части (половины) лица вплоть до способности доминировать.

Соотношение экспрессий нижней и верхней частей лица в оценках бимодальных аффективных состояний. Многозначность отношений целое/часть поддерживается спецификой отношений между частями. Выявлены два способа их реализации, избирательно связанные с содержанием эмоций.

В соответствии с первым оценки эмоциональных состояний человека по экспрессиям разных половин одного и того же лица не меняются. Обе половины несут сходный аффективный потенциал. Результат получен при условии, если бимодальное целое больше каждой из частей (гордость, удовольствие, тревога, печаль, раздражение) или равно им (радость, страх, горе), охватывая в совокупности 57% аффективных категорий. В обоих случаях значения продуктивности восприятия располагаются в границах точности идентификации бимодального целого.

Согласно второму способу оценки бимодальных состояний по экспрессиям смежных половин статистически различны. Более высокие оценки верхней части отмечаются чаще, чем нижней, что соответствует исследованиям восприятия мимических экспрессий открытого лица (Барабанщиков, 2012б, 2016; Барабанщиков, Жегалло, Королькова, 2016; Барабанщиков, Королькова, 2020; Boucher, Ekman, 1975; Wegrzyn et al., 2017). Экспрессивные потенциалы частей лица расходятся. Этот результат связан с двумерными отношениями «целое больше/равно одной из частей» (облегчение, отвращение) и «целое меньше/равно одной из частей» (развлечение, интерес, удивление, гнев), охватывая 43% аффективных категорий. В последнем случае продуктивность восприятия выходит за границы точности идентификации целого (14%) и выглядит парадоксально. Дивергенция оценок экспрессий разных половин лица является предиктором доминирования экспрессивного потенциала одной из половин над целым.

Сравнительный анализ рассмотренных данных говорит о том, что место исходных отношений целого и части («целое больше частей»), характерных для восприятия унимодальных выражений аффективных состояний, в условиях бимодальности занимает система многомерных отношений целое/часть, по-разному развертывающаяся в зависимости от семантического содержания эмоции. В этой системе части играют более активную роль, не только совпадая с экспрессивным потенциалом целого, но и преодолевая его значения. Хотя визуальные различия разделенных экспрессий одного и того же лица остаются неизменными, их взаимные отношения в контексте бимодального целого меняются. Возникает новая архитектоника целостного выражения и восприятия эмоционального состояния, в которой модальные образующие опосредуют друг друга. В центре внимания оказывается динамика выражения лица, тогда как просодические экспрессии присутствуют «на втором плане». Несмотря на низкую продуктивность восприятия самих просодий, без их участия появление нового качества и реорганизация экспрессивного потенциала и частей, и целого лица были бы невозможны.

Расчеты долей демонстрируемых эмоций с учетом оценок экспрессий каждой из половин лица показывают (табл. 1), что превосходство бимодального целого и его равенство каждой из частей одного и того же лица фактически совпадают (43% и 42%), а превалирование отдельных частей занимает 14%. Иными словами, введение нижней либо верхней окклюзии лица ухудшает оценки лишь 43% аффективных категорий, а 14% воспринимаются более эффективно, чем целое. При необходимости установления продуктивности восприятия мультимодальных выражений состояний человека в условиях частично открытого лица принципиальным становится вопрос о содержании эмоции.

Кросс-модальные отношения. Специфика рассмотренных отношений обусловлена организацией мультимодальных выражений, когда одна из образующих, т. е. часть совокупного целого, рассматривается в качестве самостоятельной целостности, разделяемой на части. Последние несут содержание не только своей, но и смежной модальности, т. е. являются двуплановыми. Подобная конструкция имеет ряд особенностей. Во-первых, возникает многократное дублирование одного и того же содержания, что создает условия компенсации информационных потерь, вызываемых окклюзией каналов. Во-вторых, существует возможность усиления восприятия экспрессий одного и того же содержания, принадлежащих разным модальностям, — явление кросс-модальной фасилитации (Dolan, Morris, Gelder, 2001; Gelder, Vroomen, 2000; Schirmer, Adolphs, 2017) как разновидности синергетического эффекта. В-третьих, общая картина взаимосвязей мультимодального целого и его частей разных уровней организации определяется содержанием целевого состояния, составом и структурой унимодальных образующих, что порождает многообразие видов отношений как совокупного целого, так и его частей.

На рис. 3 частота релевантного выбора просодических экспрессий в зависимости от их содержания показана горизонтальными отрезками прямых. Представленные значения заимствованы из работы В.А. Барабанщикова, Е.В. Суворовой и А.В. Малионок (2024), проведенной в условиях максимального приближения к процедуре обсуждаемого эксперимента. Нетрудно заметить, что точность идентификации вокальных экспрессий по сравнению с лицевыми имеет более низкий уровень и по-разному зависит не только от содержания, но и от условий экспозиции (целое/части). Это означает, что вклад просодий в восприятие бимодальных выражений систематически меняется. В отдельных случаях эффект фасилитации и/или частичная компенсация скрываемых экспрессий лица могут отсутствовать либо иметь отрицательные значения.

Общее влияние интонаций голоса на распознавание бимодальных выражений проявилось в повышении среднего уровня точности оценок. Совокупная точность идентификации разномодальных экспрессий по верхней и нижней половинам лица в нашем исследовании буквально совпадает с оценками унимодальных динамических выражений полностью открытого лица (Барабанщиков, Суворова, 2024). Экспрессивные потенциалы бимодальных состояний каждой из частей и унимодальных выражений целого лица эквивалентны.

Идентификация бимодальных состояний, валентность и уровень активации. В оценках бимодальных экспрессий по частично открытому лицу разной валентности воспроизводятся слабые тенденции, описанные нами в других работах на экспозициях целого лица (Барабанщиков, Суворова, Малионок, 2024; Барабанщиков, Суворова, 2024). В общем ряду точнее воспринимаются положительные эмоции — особенно радость, развлечение, удовольствие, облегчение. Хуже оцениваются отрицательные экспрессии, хотя многое зависит от их содержания: например, тревога и гнев выступают как полярные категории. Наименее точно идентифицируются амбивалентные состояния.

Зависимость оценок бимодальных состояний с частично открытым лицом от уровня возбуждения проявилась при демонстрации родственных эмоций аффективных групп B (тревога/страх) и D (раздражение/гнев). Тревога воспринимается очень неточно (по нижней половине лица — 0,23, верхней — 0,31) и значимо отличается от оценок целого (0,55). При экспозиции страха характер ответов радикально меняется. Точность оценок состояния по частям кратно возрастает (нижняя половина — 0,63, верхняя — 0,55), тогда как идентификация выражений полностью открытого лица остается без изменений (0,6). Статистически значимые различия трех контролируемых параметров отсутствуют. Сходная картина наблюдается на экспозициях бимодальных эмоций группы D. Одинаково невысокие оценки эмоций по верхней (0,42) и нижней (0,42) половинам лица, выражающего раздражение, значимо отличны от оценок целого (0,62). С усилением активации эмоции гнева его оценки по каждой из частей достигают наиболее высоких значений (по нижней половине — 0,70, верхней — 0,79), превышающих точность идентификации выражений полностью открытого лица.

Сравнительный анализ представленных данных и результатов предшествующих исследований (Барабанщиков, 2025; Барабанщиков, Суворова, 2024; Барабанщиков, Суворова, Малионок, 2024) показывает, что рост точности оценок с увеличением степени возбуждения, зарегистрированный в условиях уни- и мультимодальной экспозиции целого лица, на уровне частей определяется содержанием эмоций. Окклюзия лица при усилении возбуждения может как изменить точность идентификации бимодальных экспрессий (группа B), так и — оставить ее неизменной (группа D).

Взаимосвязь оценок бимодальных состояний в условиях полностью и частично открытого лица натурщика с полом и возрастом наблюдателей носит точечный характер и на общие результаты практически не влияет. Различия по полу зафиксированы при идентификации состояний интереса и тревоги целого лица; точность оценок выше у женщин. Преимущество мужчин обнаружено на экспозициях развлечения по верхней половине лица. Единственная достоверная корреляция между точностью оценок и возрастом наблюдателей получена на выражении удовольствия полностью открытого лица; с увеличением возраста релевантность оценок возрастает (r = 0,331, p < 0,05).

Согласно проведенным исследованиям, структура продуктивности восприятия выражений целого и частично открытого лица бимодальных аффективных состояний неоднородна и зависит от категории эмоций. Более продуктивное восприятие целого по сравнению с каждой из половин лица зарегистрировано в менее половины случаев (43%), столько же при совпадении результатов, в 14% случаев более продуктивными воспринимаются экспрессии отдельных половин. Хотя экспрессивный потенциал целого в условиях мультимодальной экспозиции сохраняет определенные преимущества, он не является исчерпывающим. Отдельные половины лица обладают высоким экспрессивным потенциалом, пересекающимся в большинстве случаев и сопоставимым с целым. Результатом перцептивной реконструкции бимодальных состояний по фрагментам подвижной поверхности лица является сглаживание различий средней точности идентификации аффективных выражений целого и его частей.

Заключение

- Продуктивность восприятия бимодальных (лицо + голос) выражений аффективных состояний в условиях полностью и частично открытого лица определяется содержанием эмоций и расположением окклюзии. В зависимости от сходства и различия точности идентификации эмоциональных выражений выделяются четыре типа отношений продуктивности, соответствующие определённым категориям воспринимаемых эмоций: «целое больше каждой из частей» (гордость, удовольствие, тревога, печаль, раздражение), «целое равно каждой из частей» (радость, страх, горе), «целое больше/равно одной из частей» (облегчение, отвращение) и «целое меньше/равно одной из частей» (развлечение, интерес, удивление, гнев).

- Многозначность продуктивности восприятия бимодальных состояний поддерживается спецификой отношений между парциальными экспрессиями одного и того же лица. В тех случаях, когда оценки целого лица больше или равны оценкам экспрессий каждой из половин, обе они несут сходный аффективный потенциал. Если оценки целого лица больше/равны или меньше/равны одной из половин, аффективные потенциалы частей разделяются. Дивергенция оценок является предиктором доминирования парциальной экспрессии над выражением целого. Эмоции верхней половины лица воспринимаются точнее нижней в два раза чаще. В условиях бимодального выражения эмоционального состояния человека уровни продуктивности восприятия экспрессий открытого лица и каждой и его половин, несмотря на недоступность значительных объемов лицевой информации, сближаются.

- Основанием исследований восприятия мультимодальных выражений целого и частично открытого лица выступает система многомерных отношений целое/часть, по-разному развертывающаяся в зависимости от семантического содержания эмоции. В этой системе части играют более активную роль, не только совпадая с аффективным потенциалом открытого лица, но и преодолевая его значения. Возникает иная архитектоника целостного выражения и восприятия эмоционального состояния, в которой модальные образующие взаимоопосредуют и взаимоопределяют друг друга.

- В качестве базового источника аффективной информации, на которой выстраиваются кросс-модальные отношения, выступают динамические лицевые экспрессии. Просодические экспрессии по отношению к лицевым оцениваются менее точно и зависят не только от содержания эмоции, но и от условий экспозиции лица — целого или части. Вклад просодий в восприятие бимодальных выражений систематически меняется.

- Введение окклюзий лица описанного типа не меняет относительную продуктивность восприятия бимодальных состояний. Как и в ранее опубликованных работах, но с меньшими различиями, точнее оцениваются положительные эмоции (кроме гордости), хуже — отрицательные и амбивалентные, имеющие свою специфику.

- Зависимость продуктивности восприятия бимодальных состояний с частично открытым лицом от уровня возбуждения обнаружена на экспозициях родственных эмоций аффективных групп B (тревога/страх) и D (раздражение/гнев). В обоих случаях низкие либо очень низкие исходные значения идентификации как по верхней, так и по нижней половинам лица с увеличением степени возбуждения кратно возрастают, достигая или превышая точность идентификации целого. Окклюзия лица при усилении возбуждения эмоции способна избирательно влиять на идентификацию парциальных экспрессий бимодальных состояний.